������ ��֪�������߽���������

��һ�ڽ��������ܵİ����ʣ��Ѿ����ڸ�֪����֪�Ľ���ˡ�����������һ�����ͽ������붯�����������Mind, �������練ӳ�ⲿ���磬ͬʱ�ܵ����������Ӱ���Ť�����о��ں�������

• Ta����ʲô�ˣ�֪��ʲô�ˣ�ʲôʱ��֪���ģ�����ʵ�Ƕ��Ӿ�����ʷʱ������֡�

•Ta�����ڹ�עʲô�����ǵ�ǰ������ִ�е�����

•Ta����ͼ��ʲô���������ʲô��Ԥ��δ����Ŀ�ĺͶ�����

•Taϲ��ʲô����ʲô��ֵ���������ڵھŽڻ�̸���������ӡ�

�Դ��˹�����һ��ʼ���о��߾������Щ���⣬����������Minsky��society of minds������ѧ�о�����Theory of minds����2006���ʱ��MIT��֪��ѧϵ��Saxe��Kanwisher��������һ����Ŀ�����ߣ������˵Ĵ���Ƥ����һ��ר�ŵ��������ڸ��ܡ����������˵��뷨����֪��������ʲô����ʲô�������˹����ܵ���Ҫ���֡�

˵��ͨ�����ӣ������������������������ţ�ij���ܹ�ͬʱ�뼸��Ů����ά�ֹ�ϵ�����Ҳ����Է����֣��������Ǽ���Ů���ѻ��֪�顣����ʵ������������Ϊ��һ��С�ľ�Ҫ��¶�ˡ�����Ҫ��ס��˭˵��ʲô�ѻ����������ߴ�Ӧ��ʲô�¡������˵������Ƥ����һ�����ر��������ЩŮ���ѵ���������ܲ���ô�����Ӱ�еļ����Ҫ�ر�ѵ���ⷽ��ġ�����족�����������㾡�����öԷ�����������ġ����Ǽ���״������ʵ�����У�һ�����˽�ԵĻ�У������Dz�����ģ�Ҳ���ǡ�����̹��������

�����������������뷴��������������Ҳ�У�����ͼ��������˵�����ͼ�����ع��ӵ�ʱ��鿴��Χ�Ƿ�����������߶������������������У����Ͳ��أ�����Ҫ�ҵ�û�˿�����ʱ��͵ط��ء���������ڹ۲��㣬֪����֪��ʲô��ͼ����һ�������ˮ̡���ŵ���Ƶ��ˮ̡ץ�������Ժ�����������ڰ��϶������أ���֪���������������������ŵ��㡣ˮ̡����취��������������������ص�ˮ���£�Ȼ���������ȥ�ҡ���˵���˶���֮�以��֪���Է�����ʲô��

С����һ����ʱ��ʼ�����������ʶ��һ���ؼ���Ӧ֤���ǣ�����ָ�������㿴���㿴���ˡ�����û�����ģ�����֪����Felix Warneken�����ڹ����ѧ������ѧϵ���������ڡ�������ʿ����ʱ������һϵ������ʵ�顣һ��һ����С����֪�����㿪�ţ�С�������⡢����ȥ��æ��С�������֪�����˽�����ϣ�������˻�������������С������һ�������˵Ļ�����Ҫ���һ�������ˣ�����ϣ����֪���������ʲô�������˹����ܵ�һ�����ı��֡�

�����˹����ܺ���֪��ѧ���Լ����������������˶�������������Ȥ�����ǣ������ǰ���������ϡ�ֽ��̸�����õ���һЩtoy examples��Ϊ������������Ҫ����ʵ������о�������Ҫ�Ӽ�����Ӿ����֡�������Ӿ���������أ��ִֶ���æ��ˢ��һʱ��ỹû��˼�����Ǹ����⡣�ҵ�ʵ���Ҿͽ����ȵǣ�����һЩ������̽����Ŀǰ���ڻ����ƽ�֮�С�

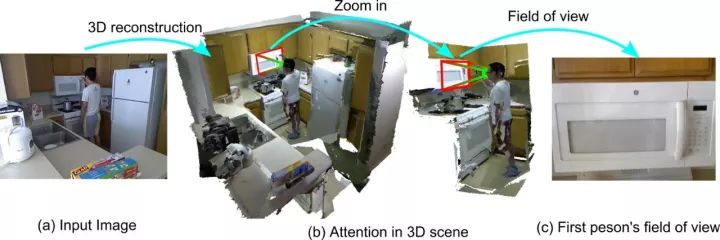

����������һ�������飬����ͼ��������ڳ������ǰ��������¯����һ������ͷ�ڿ������������һ����Ҳ�����ǻ����˵��۾���ͼ�������ܹ�������Ŀǰ�ڿ�ʲô��ͼ�У���Ȼ��ת���ӽǣ�������Ŀǰ������ʲô��ͼ�ң���

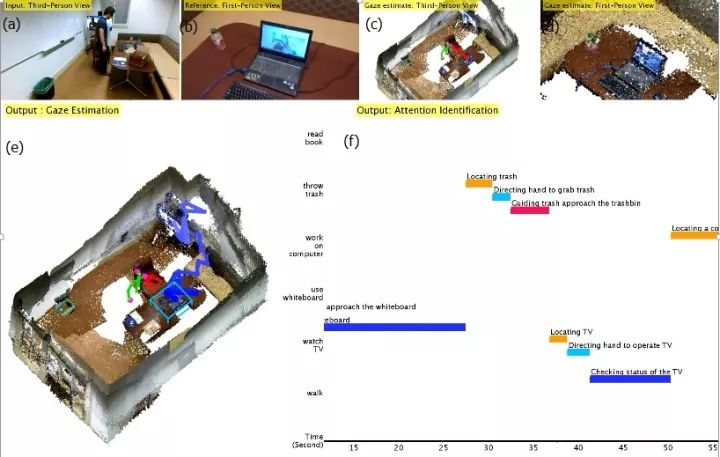

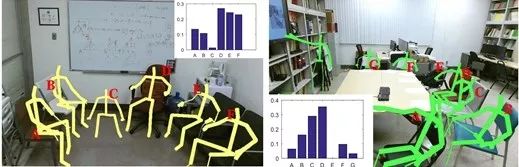

�������ͼ��ʵ�����Ƶ�Ľ�ͼ����������������Ѿ���Ϥij����ά���䣨ͼe�������ڹ۲�һ�����ڷ����������£�ͼa����Ϊ�˷������⣬���Ǿ���������һ������Ժ����ҽԺ��������������Ҫ֪������������ڸ�ʲô����ʲô��ͼc�����������������һ����ά����Ƶ��ͼa��������ʼ��������˵��˶��켣���۾�ע�ӵĵط�����ʾ��ͼe����Щ�켣��ͼf����Ϊ���ࡣȻ��ͼd�����Ͻǣ�������������ģ������Ӧ���ڿ�ʲô��ͼƬ��Ҳ���ǣ����������嵽��������ϣ�����֪����������ͼb�Աȣ��dz��Ǻϡ�ͼb������˴�һ���۾����۾���һ��С����ͷ��¼�����ģ���ȷʵ�ڿ��Ķ��������ʵ������κƽ��ʿ�ṩ�ģ�����������ǰУ��֣������ʦ�����һ�������ʦ����ʿ�ڼ�����ʵ���ҷ��ʣ������ֻ������ޡ�

��������Ҫ�Ʋ���������ʱ�ս�����������ʱ���ת��������Э����Ȼ��һ�����������ʲô����ͼ�ȵȡ����ϸ���Ҳ��ི�ˡ�

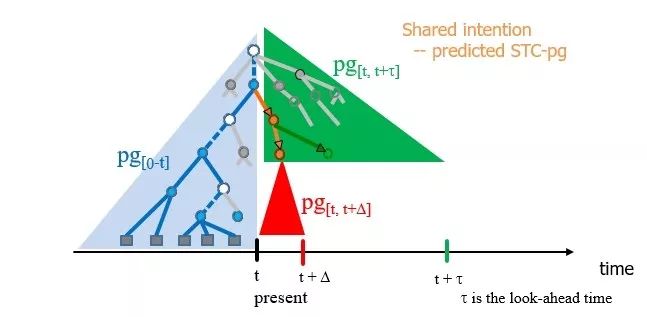

����������ĵ�״̬��Ҳ������һ��STC-AOG ��STC-PG ������ģ�����ͼ�����°����IJ��֡�

һ��ʱ������ĸ��ʡ����ͼ����STC-AOG����������˵�һ���ܵ�֪ʶ�����������еĿ����ԣ��Ҵ�������һ������������⡣ ʣ�µ������Ե�ǰʱ�յ�һ�������һ��STC-PG����ͼ���˽���ͼ���������֣�ͼ�б���Ϊ���������Σ�ÿ��������Ҳ��һ��STC-PG ����ͼ��

������ǰ���龰situation������ͼ����ɫ�����α�ʾ����ǰ�������ʲô����Ҳ��һ���⣬��ʾ�Ӿ���0-tʱ���֮�����������������һ������ͼ��

���������붯���滮ͼ������ͼ����ɫ�����α�ʾ����Ҳ��һ����λ��Ľ���ͼ��Ԥ�������滹����ʲô���飬

�ġ���ǰ��ע����������ͼ�ĺ�ɫ�����α�ʾ�����������ڹ�עʲô��

������������ͼ����һ�飬�����ϴ����������Դ��Ĺ�ȥ�����ڡ�δ���Ķ���ʱ���ڵ�״̬����һ��ͳһ��STC-PG �� STC-AOG�����͡� ����һ����εķֽ⡣ ��Ϊ��Composition�� ����Ҫ�������ͺ��١�

����Ҫ˵�ˣ��ҵ����������Ҳ�в�Σ���һ�ٶ���ء���Ҫ˵���ǣ�����һ�ٶ����ʵ��ֻ��һ�㣬�Բ��ԣ���Ϊ������������ʶ���м�Ķ�����ʲô�㲻֪����������ȥ�����м���Щ���̣�ֻ�����һ������������

����˵���������ǻ����˶�ij��������״̬��һ�����ƣ����������һ��������ʣ�������Ʋ���Ψһ�ģ����ڲ�ȷ���ԡ����ң����϶��������ࡣ��ͬ���˹۲�ij���ˣ����ܹ��ƶ���һ������ô��һ���������˹�������Ļ����У����������������N�������˻����ˣ��������кܶ�N�������ҡ�minds��Ȼ��ÿ�����жԱ�����һ�����ƣ������N x��N-1����minds�����֪��������ʲô����֪��������ʲô����������ƽ�����ġ�����һ�ٸ����ѵĻ����ĸ��������Դ�����ʲô�����ﶼ��������ϵԽ��������Ҳ��Խ�Խȷ��

��Ȼ����������ֻ����һ���������ڸ��ӡ��Կ��Ļ����У����Dz��ò��ö�ı������˾��ܲ�����������ɽ����ʱ���������˾��ܲ����Ҫ����һ�ס���ν������թ��������ʱ���ҹ����һ��������Ϣ�����㣬���������塷�кܶ����ľ��ʹ��£�������褴�Ƹǡ����ɵ��顣

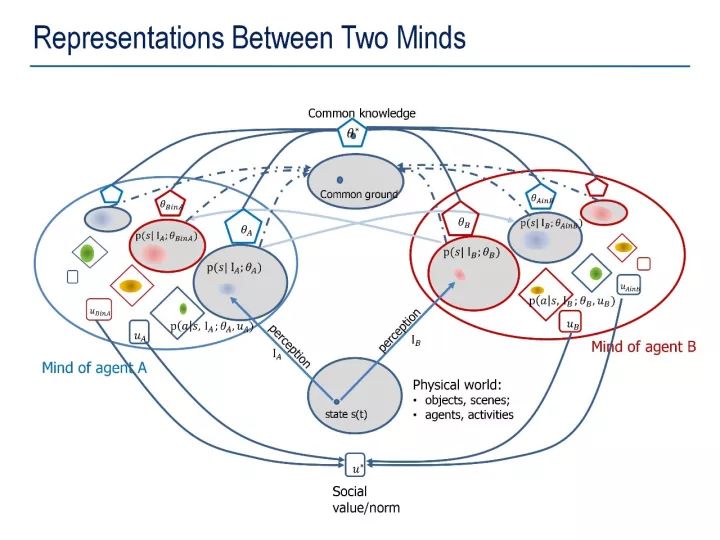

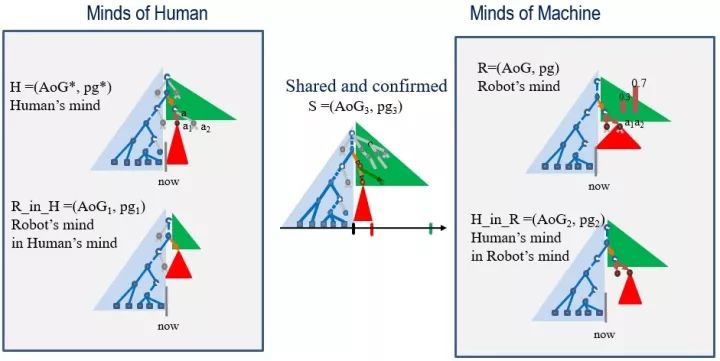

�����������ͼ�������ܽ�һ�¡�������A��B����һ����һ�������ˣ������Դ�����ı���ģʽ��ͼ����һ��Ƕ�ĵݹ�ṹ,ÿһ����Բ����һ�����Ե����� mind��

ÿ��mind��������̸����֪ʶSTC-AOG ��״̬STC-PG���������˼�ֵ���������Ǽ�ֵ�ۣ��;��ߺ�������ֵ������������Ȼ����ݸ�֪���ж�ȥ�ı����磬��������ͳ����ˡ��Һ�����ϸ̸������⡣

������м���Ǹ���Բ������ʵ���磨���ϵۡ���mind������ֻ��TA֪�������Ƕ���֪�����������м���Ǹ���Բ�ǹ�ʶ������˵Ļ�������Ṳʶ���ڸ�֪�����ϣ�����γ�һ��ͳһ�Ķ�������ͬ���⣬���Ǵ�ɹ�ʶ�����磬���һ��Է����������ˣ���Ҷ������������ʲô�ˣ����û�й�ʶ��û��Ū�����磬��ָ¹Ϊ�������ߡ��ʵ۵���װ������������Щminds֮������˲�һ�µĶ�����������ν����ʶ�ۡ���������⡣��ǰ���ڴ�ѧѧϰ��ʶ�ۣ���ʦ���ñȽϿշ����������⣻������ѱ���д������һ�ж�����ˡ���Ҳ���˹����ܱ����������⡣

����Ҫ��ɹ�ʶ����ͬ��֪ʶ��Ȼ����һ��С�����塢��������ɹ�ͬ�ļ�ֵ�ۡ������˹�ͬ��ֵ�۵�ʱ���������º������淶���ⶼ�����Ƶ������ˡ���˵���������ס��������һ���µ���������罻Ⱥ�壬������ȹ۲쿴����Ҷ�����ô����˵���ġ�������Ҫ���˹������� ���������˵�����������º������淶������˵�������ʶ���ǻ����˷�չ�ıؾ�֮������ѻ֪�������ڸ�ʲô�������ܹ������������������档

��ô��δ�ɹ�ʶ�أ����Ծ��DZ�Ҫ���γɹ�ʶ�Ĺ����ˡ�

���߽� ����ͨѶ����ͨ����֪����

��Ҫ���ܵ��˹����ܵĵ��������������ԡ��Ի���������������Ӿ������Խ�ϵ����ֻ������˱��棬�����Լ��۲�ĽǶ���̸���Ӿ����������ܲ��ɷֵġ�

��������������Ƕ��صģ���Ȥ���������˶��滮���ĸ���������ΪʲôҪ�Ի��أ����Ե���Դ����Ҫ��һ�����Դ���mind����һ����Ϣ���ﴫ����һ���ˣ���Ͱ�����һ�ڽ���֪ʶ��ע�⡢����ƻ�������Ϊͼ�������������εı��ϣ��ͨ���Ի��γɹ�ʶ���γɹ�ͬ������滮����������һ���ж������ԣ����Բ����Ļ�������ҪѰ�������

����֮����Ѿ��зḻ�Ľ����ķ�ʽ���ܶ������֫�����ԡ��˵ĶԻ���һ�������ԣ�����ƾ磨pantomine��ͬ�����Դ��ݺܶ���Ϣ�����ԣ������Բ���֮ǰ��������Ѿ�����ʮ�ַḻ����֪������Ҳ������һ��̸����Щ���û����������֪�����������ǿն��ķ��ţ��Ի�Ҳ�����ܷ�����

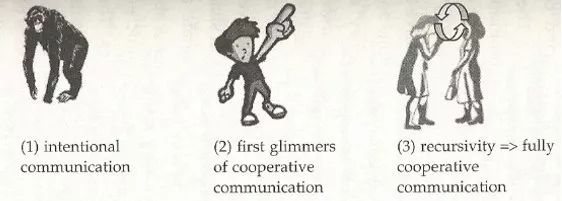

��������ѧʵ�������12���µ�С���Ϳ���֪��ȥָ��������С����Ͳ��ᣬ���Ǻܶද����Զ�ﲻ�����ˮƽ���ٸ����ӣ��������˸�ʵ�顣һȺ���������ڶ����һ�����������һ��С���ɣ���������С�����ܲ����ˣ�Ȼ���������ȥ�ҡ���Χһ������ŵ�������������ɹ̫������������֪���Ǹ�С����ȥ���ˡ�������˵Ļ������Ǿͻ����ĵ�ָ�Ǹ�С���ķ����������Ǻ����ģ�ȥ�������˵ģ�����Ϊ�֣���������Ϊʲô�����˽��������ˡ����ɲ��ᣬ���ɲ�ָ������û����������������Դ��������һ����ȱ��һ�顣�˺Ͷ�����ȣ�����֮�����ܹ������Ǹ�������Ϊ�Դ����кܶ�ͨ�ŵ���֪���ܣ�����������ͨѶЭ�飩�ڴ���Ƥ�����棬û����Щ��֪���ܾ�û��ͨ�š��о����Ե��˲�ȥ�о����µ���֪���ܣ����Dz����кܴ��Ϣ�ġ��������ͼ��Դ������ѧ���о���һ��������� Michael Tomasello��

������Ҫ�����֪���������Ե��о������������Ӿ����ⲿ����ĸ�֪���������˶�������������������Ծ�����Դ֮ˮ���ޱ�֮ľ����Ҳ����Ϊʲô��ǰһЩ��������˶��ڡ����ס���

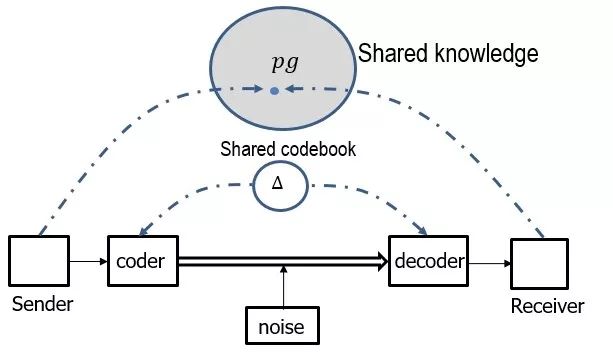

����������һ��������ĵĹ��̣���Ϣ��һ�η��͡���ij�ף�sender��Ҫ����һ����Ϣ��ij�ң�receiver��������һ����ͨѶcommunication�����ͨѶ����ѧģ���ǵ��건��ʵ������ũShannon1948�����������Ϣ�ۡ����Ȱ������룬��Ϊ�����������Ƚ϶̣��ȽϿ죻�������ͨ������Щ�����������Ȼ����룬ij�Ҿ��õ��������Ϣ������ͼ��

�����ͨѶ����֮���������������ļ��衣��һ�������߹���һ���뱾��������û�����룬����һ���������衣�ڶ������������и��������ⲿ�����֪ʶ�����棬���Ƕ�֪�����������ڷ���ʲôʲô�¼��������ĸ���Ʊ����Ҫ���ˣ��ĸ��ط�Ҫ����ʲôս���˵ȵȡ��Ҹ��㴫��ȥ�������Ϣ��ʵ��һ������ͼ��Ƭ�Σ�PG��parse graph�����������ͼ��Ƭ�ζ����������������һ��״̬���߿��ܷ�����״̬�����������״̬Ҳ�п��ܾ������Դ�Mind�����һ���뷨���о�����̬��fluents�������磬�ܶ�Ů������绰�����������ࡱ�����ڽ������ĵ�һЩ�������ܡ�

���û�������ͬ���ⲿ���磬���Ҹ����Ͳ�֪������˵ʲô����������˾���һ��һ��Ц�������ǿ����������������й���˵�����������Ƿdz��ḻ��һ���Ļ����ţ����Ƕ�����˭��������������������С��Ը�ͼ�ֵ�ۣ����ֵ�������������ˡ�

Shannon��ͨѶ����ֻ�����뱾�Ľ�����������Ƶ����룩��ͨѶ������3G,4G��5G����1948�������Ϣ�ۺ����кܶ�����ˡ���ѧ����ǿ���˽�����������������һֱû��ʲô���ͻ�ơ�Ϊʲô����Ϊ���Ǻ����˼������ش����ʶ�۵����⣬�ܶ���̸��

•��Ӧ��Ҫ��һ�£����Դ������Ƿ������һ����ͬ������ģ�ͣ�������֮����Ҳ���������������ݣ�������⡣��ô�ҷ������Ϣ��ʱ���Ҫ����������������⡣

•��Ӧ��Ҫ��һ�£�ΪʲôҪ�������Ϣ�����Dz����Ѿ�֪���ˣ��ҹز���ע�����Ϣ�أ��Ұ��������أ�������ʲô��Ӧ����һ�仰˵��ȥ��ʲô����أ�

•��Ҫ��һ�£���ΪʲôҪ�������Ϣ�أ��㷢������ʲô��ͼ��

��������֪����ģ��ݹ�ѭ������֪���ڱ���֮�⡣���ԣ�ͨѶ���۾�ֻ�ܷ��ͣ�������ǰ�籨��¥�ķ���Ա����Ǯ���������Dz����㷢���Ķ��������ݺͺ����

�ݹ��������ԣ��й�����������ʵ���˲�����ν�������־���ȫ�ǡ�����ͨѶ����ÿ���־����ⲿ�����һ��ͼƬ����һ���������ˣ�����Ҫ����롣�Ҿ����о���Ȼ���Ե��˺��о��Ӿ�ͳ�ƽ�ģ���ˣ���Ҫ�úÿ����й��ļ��ģ�Ȼ�����е����鶼����ˡ�ÿ�������־���һ��ͼ��ͼ��ʲô�������ľ���һ������ͼ��Ƭ�Σ�fragment of parse graph����

�������ͼ��һ�����ֵ��ݱ��ϵͼ����һ����������������������ġ�����ǰ���ҵ�̨����ʣ������Ȿ���飬������˼�����ͼ�Ǵ��۾���ʼ��һϵ�����֡�

���ȴӾ���Ķ�����ʼ�����м���һ���۾�����Ŀ���֣����ִ����۾����棬����վ�����������������ǡ�������look����

Ȼ���ǻ��⣬���硰ʡ��������ϸ���������������һ����С��Ҷ�����۾����棬ָʾ˵�㿴Ҷ������Ķ�������ʾ��Ҫϸ����

Ȼ��ʼ�������ĸ������attribute��ʱ����ô����������Ǽ������棬��ʾ��������ֹ����ʾ�˵Ĺ�ϵ���˵��Դ�״̬�����������������¡���������һֱ���ݿ���

���ԣ����Ӿ���֪�ģ�Ҫ�������幦�ܾ�Ҫ�ݵ�ʯ��ʱ��ȥ�������Ե�Ҫ�ݵ�������Դ��

��ͼ����һ�����ӣ��ա��¡�ɽ��ˮ��ľ�������㡢���������ɫ��ͼ������ʵ���������ü�����Ӿ�������ͼ���еõ���һЩ����ı���ͼģ�ͣ���ʵ�����·���һЩ������ļ��ġ����������YiHong��˾�����Ȳ�ʿ�����ලѧϰ�����ǵ��㷨�����˴��������ͷ�����Ӻͽš�ˮ����ˮ�ݵȡ�����ġ����ʷ��š������Ӿ��ı���ģ���ǿɽ���explainable��ֱ�۵ġ�

���ԣ�������ʽģ�͵ĽǶ����������Ծ����Ӿ����Ӿ��������ԡ�

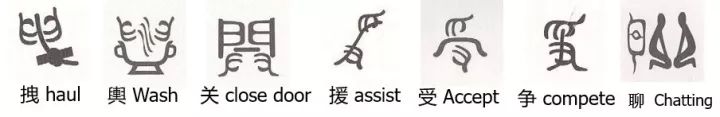

�����������ʡ��������ǣ�����ɶ��˼����һ���֣���ֻ�֣�һ�����ӣ����ϵ���һ���������ø�����ק���ڶ����ܼ�ϴ�֡������ǹ��š�������Ԯ����Ԯ�֣�һֻ�ְ�����һ���˵���������������Ҳ�������֣�һ���ֳ���һ���ֳ��ϣ�ɶ��˼���Ҹ��㶫��������ܡ�������������������������෴�ķ����������������������졣�����ϣ����Ѿ���ʾ���˺���֮��Ķ���ϸ�ڡ�

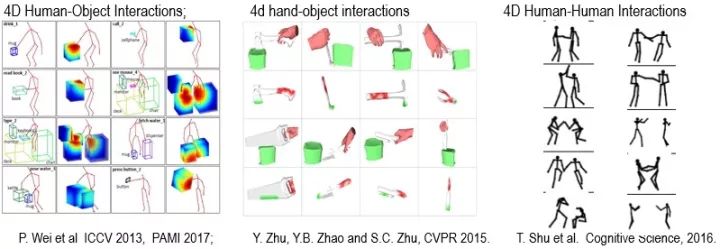

�����ҵ�ʵ����������Ҳ���Զ�ѧ��������ġ��Ķ��ʵı������ͼ������ѧ��������Щ�����˽����Ķ����������������ֻ������֡������˵ȵȡ����ǰ���Щ����ģ�ͷֱ����4DHOI��4D Human-Object Interaction����4Dhoi��4D hand-object interaction����4DHHI��4D Human-Human Interaction����

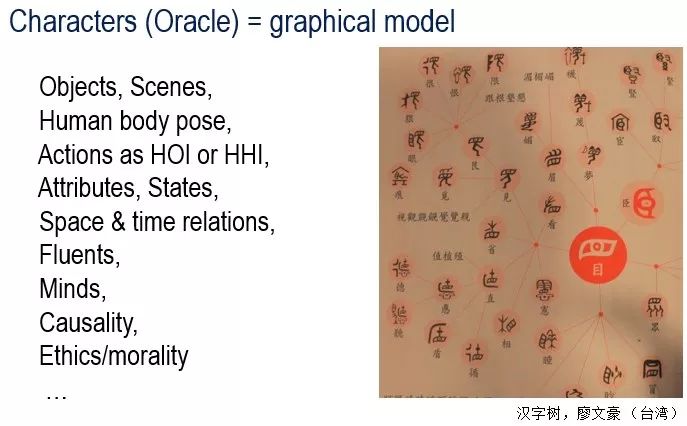

�Ҹղ�˵�����ʺͶ��ʣ����кܶ������Ķ������ҽ�������ȥ�о�һ�£�Ҫ��ģ�͵Ļ����ǹŴ��ļ�����ʵ����һ��ģ�ͣ����ܹ�������������������Ҫ����Ķ�������������ˣ���һ���걸�˵�����ģ�͡�

���پٸ����Ӻͳ�������ӣ����ǹŴ�����ô�����������£��dz���Ư����

������̸������ҵ��Ļ����˽�������Ժ��Dz��ǻ�Σ���������棬���������˺ܶ����ۡ���һ���Ҳμ�һ��DARPA�ڲ����飬���������˸������������������⣬���������������ѧ����֪��ѧ���˹����ܵ�ѧ�ơ����Ī��һ�ǡ��ֵ��������棬�Ҿ�˵����ʵ������⣬�й��Ŵ��˵��ǻ۾��Ѿ�������ˡ�

�������µġ��¡�����ô����ģ�ʲô�е��£�

���¹淶��ʲô�����Ǹ���ԵĶ��壬����ʱ�����Ⱥ���仯���Ҹ���������ʱ������������̥������ͬ���������ڶ������ˡ��й���ǰ��Ů�������ļޡ���������ʮ��ǰ�����ڼ��綼��˵�����Ĺ�أ����һ����Ů��·�ϣ�����Ӱ��Ͷ��һ���������ϣ����Ǵ���������·�����ƿ��������һ�����淶��

����������¡����㿴�����˫���ԣ�˫������ʵ���������ˣ�˫�����ڼ��Ļ�����ʮ��·�ڣ������ұ��Ǹ�ͼ����ʮ��·�ھ���˵����Ҫ����ѡ���Ǹ����ߡ�����ôѡ����˵һ�����˵��ڵ��ϣ����Ƿ������Dz������������һ��ѡ��̰��̰�ۡ��ܲ��ܻ��ⶼ�����ĵ�һ��ѡ�����ѡ�����������������ģ����������и����֡�

����ô�ж������ĵ�ѡ��������ϵ����أ������ܰѴ������������г�����һ������Ҳû��������ô������ݰɡ����¡���������һ��ʮ�֣�ʮ������һ���ģ���ʵ�����ģ������۾���ʮ���۾������㡣������Ⱥ�������еġ�����൱�������������ţ������Ŷ�����ͨ��������ѡ�����ģ����Ǹ���һ��ķ��ɹ淶�ˣ�������������������������ܹ����ܾ��ǵ��£�����������Ǿ��Dz����¡����ԣ�������ѡ���ʱ���뿼����Χ�˵Ŀ������˼��Դ������ô�룬�ž������������������

���ԣ����û����һ�ڽ�����֪������Ҳ��������������ƶϱ��˵�˼�룬�Ǿ���֪�������������о������˵�һ������Ҫ��һ�������ǣ�����Ҫȥ������������֪���ò���������ô��������һ�£����൱����������simulation�����������������飬�˻���ʲô��Ӧ�������Ӧ�þ����������Ӧ���þͲ���������ôһ�������Բ���Ӧ��䡣

������ô֪������ô����أ����������˽��㣬��ϲ��ʲô�����ʲô��ÿ���˶���һ�������ڲ�ͬ��Ⱥ�����棬��Щ����˵����Щ������˵��������ﶼ֪��������ǽ�������û���ⷽ��֪ʶ����ô�����أ�

�����һ��Ǿ������ǹŴ����˺����ǻۣ����������ڵ��������̵Ķ࣬һ���־Ͱ�һ������˵�úܾ��١��������ڴ��˲������⣬��Ϊ�㲻��Ҫ�������ˣ�����ý�塢��浽�����ǣ�ʱʱ�̿��������������⿴�����������������ʲô�أ�ֻҪ���־ͺ��ˡ�

���ڣ����ǻص�����ͨѶ����������˶Ի������⡣��ͼ�����������һ����֪ģ�͡�

������֮������Ҫ��������Դ�minds����֪���Ķ�������֪���Ķ�������֪����֪���Ķ�������֪����֪���Ķ��������ǹ�֪ͬ���Ķ��������У��Ի���ʱ�������ͼ��ʲô�ȵ�������⡣�����Ҳ�����ô���ˡ�

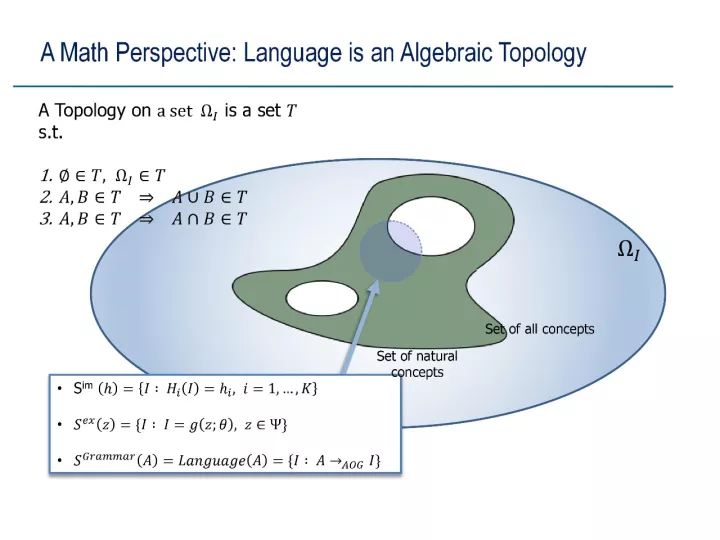

�������̸һ�㣬�������Ӿ���������ϵ������ѧ�д������˵���ϵ������ѧ��ʲô��˼������˵ͼ��ռ䣬���Կռ䣬����һ���ϣ�ȫ�������ǵ�ÿ����������������һ���Ӽ�������˵�����е�ͼ����һ�����ϣ�һ��������ؾ���һ����ά�ռ䣬ÿ��ͼ����������ά�ռ��һ���㡣�����Ǹ�������е�������������һ����ά�ռ��һ���Ӽ�����������Ӽ����������Ӽ�Ҫ������ϵ�������ϵ�����˹�ϵ����������˰������������Ӧ�ڴ������ˡ����磬ͷ�Ͳ����ڼ�����ǺϹ�ģ����ʺܸߡ����ͼ��ռ�Ľṹ��ʵ���������������STC-AOG��ʱ����������ͼ����ɵ��������ԡ������Ծ���һ��������ľ��ӵ��ܵļ��ϡ�STC-AOG����֪ʶ�������������ǿ�������ǰÿһ����������STC-AOG��������ʱ���������ͼSTC-PG��������Ӿ����������Կ϶���������֪����������������滮Ҳ�����������һ��ͳһ�ı��

�ڰ˽� ������������ȡ����������ļ�ֵ��

������Ҫ���˽����������붮�������ֵ�ۡ���ѧ�;���ѧ������һ���������裬��Ϊһ�����Ե��ˣ�rational agent����������Ϊ�;��߶�������ͼ�ֵ�������������Լ������������˶�Ӧ���Ƿ����Ե��ˡ��������Ե��ˣ���ͨ���۲�������Ϊ��ѡ�Ϳ��Է���������ѧϰ���������ļ�ֵ�ۡ�������ʱ�ų����п��ܹ����װ���Ի����ǵ������

�����ֵ�����ǰ�������Ϊһ�����溯��Utility function����һ������U��ʾ����ͨ�����������֣���1��Loss��ʧ����������Reward������������2��Cost���Ѻ���������˵������һ���µõ��������棬���Ѷ��ٳɱ������ǿ���������溯����������̬�ģ�fluents���ռ����档����ÿ���ж����ı�ijЩ��̬���Ӷ���U����Ŀռ��������ߣ�Ҳ���ǡ���ֵ�����ɺ���U����̬����F���ֵĻ����͵õ�һ����������

��ϰһ�¸ߵ���ѧ�����Ǽ���һ������ij��ʱ�ڣ����ļ�ֵȡ����ì�ܵġ����磬�������ΪA��B�ã�B��C�ã�Ȼ��C��A�ã��Ǿ�ѭ���ˣ���ֵ�۾Ͳ���ǡ�����ڳ����о���һ�������С���һ���������������ij����ͽ���һ�����س�������ڵļ�ֵ��U����һ�����ܺ�����

��ν�������ߴ��ߡ�ˮ���ʹ�����˵��������������������ͬ��������ȫһ�¡������˺�ˮ���ڰ��ո��Ե����ܺ������˶�����ô�����˵����ܺ�����ʲô�أ�

�����˵ļ�ֵ��ͬ������ͬһ���ˣ���ֵ��Ҳ�ڸı䡣���IJ�������Щ������ļ�ֵ�ۣ�����ָ����һЩ������ġ���ʶ�Եġ����ͬ�ļ�ֵ�ۡ�����˵�ѷ�����ʰ�ɾ��ˣ��������ǵĹ�ʶ��

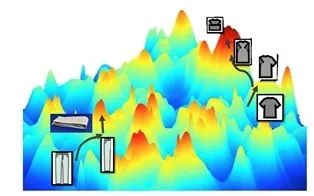

��ͼ��������һ����ʵ�顣�ҰѼ��ֲ�ͬ�����ӡ����ӷ����Ұ칫�ң���ͼ����ʵ���ң���ͼ����Ȼ����ͳ��һ��ѧ�������Ժ���ϲ�����ĸ����ӣ�ʵ�ڲ��п��������ϡ������ҾͿ��Եõ���Щ���ӵ�����A��B��C��D��E��F��G�Ÿ��������ͳ��ͼ���ҹ۲�����Щ�˵�ѡ���ʣ�Ϊʲô������ӱ��Ǹ����Ӻã���ʲô�ã�����ʵ�ͷ�ӳ���˵��Դ�����һ�������ļ�ֵ��������˵һ�飺����ͨ���ճ������̺���̵ĵ�·��ƻ����ز���������?���˾�ռ����ˣ��Ͳ�ȥ����������ˡ�

Ϊ�˽�����⣬�ҵ�������ʿ�������κ�������ͼ��ѧ�Ľ��������ո�ȥUpenn���ݴ�ѧ���������ڣ�����ͼ��ѧ����������ģ��ģ���˵ĸ��ֵ����ƣ�Ȼ��������Щ��������Щ�����ϵ�ʱ�����弸���������ֲ�ͼ������ͼ�����米�����β���ͷ���ܶ�������

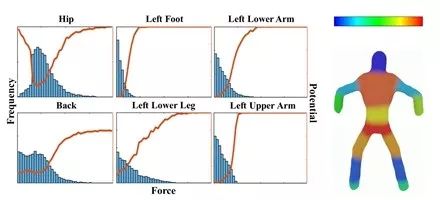

��ͼ����ɫ��ֱ��ͼ��ʾ���������岿λ�������ֱ�ͼ���ɴ����ǾͿ��������ÿ��ά�ȵļ�ֵ����������ͼ��������ɫ�������Ǹ��ļ�ֵ���������˵�����ʹ�ø���λ�������ں��߽ϵ͵�ֵ�����нϸߵġ���ֵ����Ҳ�������á����������Ȼÿ���˿��ܲ�һ�����е������۱�����Ӳ������е���ϲ������ɳ������Ҳ��Ϊʲô�������۲쵽��Щ�����������Ƶ������ij�ط����������ˡ�

��������㲻��Ҫ�ʣ��ⲻ�������������ܺ���������������һ���𣿶ԣ�����һ����������Ҳ�������һ���ҽ�Ҫ˵�ģ��������ţ�ٵ�������ϵҪͳһ��

��������dz�ʶ�����ǻ����˱��������ܶ������ij�ʶ��TA��Ҫ��������Ϊ�����룬����Ͳ������ˡ�

���·�Ҳ��������������һ�����ӡ�������ǰ�������ص����ܺ������ӻ�Ϊһ������ͼ����ô���һ���·��Ĺ��̣�������һ����ɽ��·��������·�����ԭ�������ˣ�����Ӧ��״̬�ڹȵף��������˾͵����ϵ�ɽ���ˡ�ÿһ����������һ������reward���Ҹ�������·��Ĺ��̣�����ɽ��״������������������֪�����·��������ı�����ʲô��������µ��·�����Ҳ����ˡ������˿����ж���ļ�ֵ�ۡ�

������̸�۽϶���ǻ��������壬�ر�����Χ�壬��ȷ�̼��˹��˵��������������һ���ؼ�����ѧϰ��ֵ����������ÿһ�����ܵ���֣���Ҫ��һ����ȷ�ļ�ֵ�жϡ������������Ϸ������ǿѧϰҲ�Ƚϻ��ȡ�����Щ�о������ڼķ��ſռ������档��ʵ������������������������ʵ���磬ѧϰ�˵ļ�ֵ������

���˼�ֵ��������һ�����˻����У������˾�����������γ�������һ��̸�������淶���������¡���Щ���������淶������Ⱥ�ھ�������֮�У��ܵ��ⲿ������������������£���ɵ���ʱ��ƽ��̬��ÿ��ƽ��̬��������һ���̶��Ĺ���Ҫ������ͬ���Ĺ涨����������һ�ָ��ʵġ���Ϊ�������������ʵ�������˵���ף����һ�ָ��ʵ�ʱ��������ͼSTC-AOG�ı��

�������������У�����ijЩ�߽������ĸı䣨���µļ������������������˹����ܣ����������߸ı䣨��ĸ↑�ţ��������˾ɵ�ƽ�⣬��ἱ��仯��Ȼ����µ�ƽ��̬����ô���淶��Ӧ������һ��ʱ��������ͼSTC-AOG��������һ��ƽ��̬��STC-AOGģ��ȥ����һ��ƽ��̬����ͳ�����ν�ġ�ˮ������������

̸���������˳��Ա�������ѧϰ������

һ������ѧϰ Inductive learning������ͨ���۲����������������Щ�������Ƕ�ij��ʱ�ڡ�ij������ij����Ⱥ��ɵ�ƽ��̬�Ĺ۲졣Ҳ����ǰ��̸����ǧ���Ļ����γ��봫�С�����ѧϰ�Ľ������һ��ʱ������ĸ���ģ�ͣ��Ұ�������ΪSTC-AOG��ÿ��ʱ�յĶ�����һ��STC-PG������ͼ��

��������ѧϰ Deductive learning��������������к��٣�Ҳ���ǴӼ�ֵ�������������������������ֱ���Ƶ�����Щƽ��̬�����ҿ�������Ҳ��һ��STC-AOG�����Ҫ����о��Ķ�������̵ġ�����ʽ��ģ�ͺ����⡣���磬�����������ɽ���Ȳ鿴���Σ�֪���Լ��Ķ��顢������������������˾��ܲ������������Ը�Ȼ�����Դ��������ݣ���֪����ô�����ˡ�

�˵�ѧϰ���������ߵĽ�ϡ������ʱ����ѧϰ�õö�һЩ������ѧϰ������һ�ֲ�����嶯������ѧ�ѣ���Ҳ���ܷ���������ء����ˡ���ʮ������ʱ��ֵ�۳����ˣ���ֵ�۸��ǵĿռ�Ҳ������ȫ�ˣ���ô�����Ͼ�������ѧϰ��

AlphaGo����ͨ������ѧϰ��ѧϰ���������֣�Ȼ�����������ȫ������ѧϰ�ˡ�AlphaGo����ֿռ�����������Ŀռ临�ӶȻ���û���ȵġ����ң������ÿ��������ϵ��һ��������ȥ������ȷ���ġ��˵�ÿ�������Ľ�����кܶȷ�����أ�����Ҫ���ѵöࡣ

�ھŽ� ������ѧ������������ƽ̨

���ڵ��Ľ�̸���˹������о�����֪���ܣ�Ӧ����С���ݡ�������ʽ�������˾�����ôһ��������Ŀ���ƽ̨��������Ҫ�����Ӿ�ʶ�����Խ�������֪����������Ҫִ�д������ж�ȥ�ı价�����ҾͲ����ܻ�е������Щ�����ˣ������������ṩ��ͨ�û�����ƽ̨��

ǰ����ܹ����˺ͻ�����Ҫִ����������ֽ��һ�����Ķ�������ÿ����������Ҫ�ı价���е���̬��

�Ұ���̬���������ࣺ

��1��������̬ ��Physical Fluents��������ͼ��ߣ�ˢ�ᡢ�տ�ˮ���ϵذ塢�вˡ�

��2�������̬��Social Fluents��������ͼ�ұߣ��ԡ��ȡ� �𡢲�����Ǹı��Լ��ڲ�����״̬������������˵Ĺ�ϵ��

���������ؽ�����ά��������̸�Ӿ���ʱ���ᵽ�ˣ�����ʵ��һ���������������ĵ������ɵĹ��̣������ʹ��Ź�����������۹������������������ͼ��ʾ���ĸ��ط�����վ���ĸ��ط����������ĸ��ط����Ե�ˮ�ȵȡ�����ͼ�����ĵط���ʾ����ִ��ij����������Щͼ�ڻ����˹滮���ֽ���Affordance Map����˼�ǣ�����������Ը����ṩʲô��

������Щ������������ĵ�ͼ�������˾Ϳ���������Ĺ滮������滮��������һ����λ��ı���������ж��ַ������һ��ǰ���ͳһ����һ��STC-PG��������̣���ʵ�൱���ӣ���Ϊ��һ������һ��Ҫ���Ͽ����³�����ģ�͡���Ϊ��ǰ����ܹ����Ի�����ά��״�ļ��㾫���Ǹ���������Ҫ�������ģ�Ҳ����Task-Centered�Ӿ����

��������ƻ��Ĺ��̻�Ҫ������������ǵ������б��˵ķ�Ӧ�����ǵĶ���Խ�࣬����Խ���죬���¾͵��塢��ççײײ��

��һ��ʼ�������Ǹ������˾�������Щ��֪�滮��������ʵ��������һȺ�ں�̨ң�ص��ˡ�

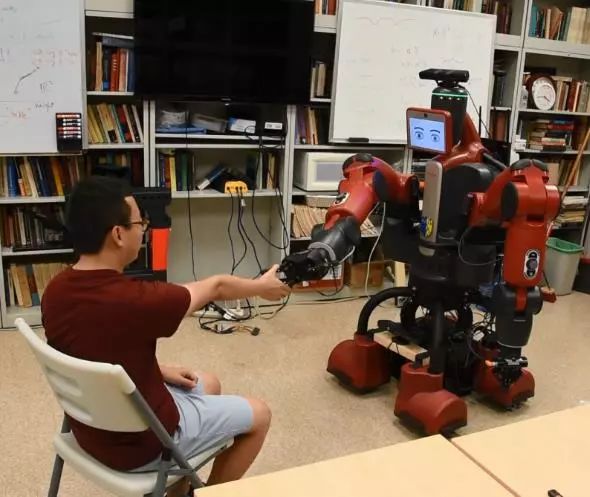

���棬�Ҿͼ��ܼ�����ʵ���ҵõ��ij�����ʾ�������̨û��ң�ص��ˡ���ʵ�����õ���һ��ͨ�õ�Baxter�����ˣ�����һ�������ƶ��ĵ���������ץ�֣�grippers��������һЩ������������ͷ�ȡ�����ץ���Dz�ͬ�ģ�����������������������˼���ǣ������۲����Ϻ�ȶ����������ǯ��Ҳ�Dz�ͬ�ģ�һ���������顢һ���Ǿ��״�ġ�

��ͼ��һ����ʿ��������̻��˻����˼����罻�������������֡����ֿ���ƽ������ʵ�dz�������߹�ȥ��һ�������ֵĹ����У�����ʵ��Ҫ����ж϶Է�����ͼ������������ξ��档����������������ý�嶼��������

���������ͼ�ǻ��������һ���ۺϵ�������������������ȥ���ţ��ƶ�����Ҫ����������ȥ���š���Σ�����������������ø�������ӣ�˫�ֱ�ռ�ˣ�������Ҫ������ͨ���Ի�����֪���Է�Ҫ�ѵ���ŵ��������棬��������ȥ���˿�������ţ�����ͼ���������������������һ��������ץ���ֹޣ�ҡ��ҡ�����������������ƶ������Ҫ��ˮ�������ֹ��ǿյģ����ɼ�����̬����������֪���п����ڱ��䣬������Ϳ��������ÿ��֣�Ȼ��ݸ��ˡ�

��Ȼ���������������Ҫ�ܹ������Ĺ�����������һ�������Ļ����Ǿͻ����ܽӽ�����ǰ���ᵽ�Ŀɾ�����ѻ�ˡ����ǻ���Ŭ���У�

��ʮ�� ����ѧϰ��ѧϰ�ļ��͡�ͣ�����⡱

ǰ��̸������������ڸ��������ϵġ�����������Domains������Ŭ������Щ�������һ���������˼����Ѱ��һ��ͳһ�ı������㷨�������Ҫ���ܵĻ���ѧϰ�����о��������������Methods�����о����ȥ��ϡ���ȡ�������Щ֪ʶ������ȷ��������������������ֶ��ӣ�����ѧϰ���о����ӣ�ϣ��ȥ����Щ���Ӵ���ȥ�����ѧϰ����һ�ѱȽϺ��õĴ��ӡ���Ȼ����������������Ҳ�����˺ܶസ�ӡ�ֻ��������⼸�����ѧϰ��Ѵ��ӱȽ����С�

���Ϲ��ڻ���ѧϰ�����ۺܶ࣬����������һ���������⣬����̽�֣�ѧϰ�ļ����롰ͣ�����⡱��

��Ҷ�֪�����������ѧ������һ��������ͼ��ͣ��Halting���⣬�����ж�ͼ����ڼ���������Ƿ��ͣ���ˡ������һ��ѧϰ��ͣ�����⣺ѧϰӦ����һ������������ͨѶ�Ĺ��̣�������������ǻ������ǵ���֪���ܵġ���ô����ʲô�����£�ѧϰ���̻���ֹ�أ���ѧϰ������ֹ�ˣ�ϵͳҲ�ʹﵽ�˼��ޡ����磬�е�������;�����ѧϰ�ˡ�

���ȣ�����ʲô��ѧϰ��

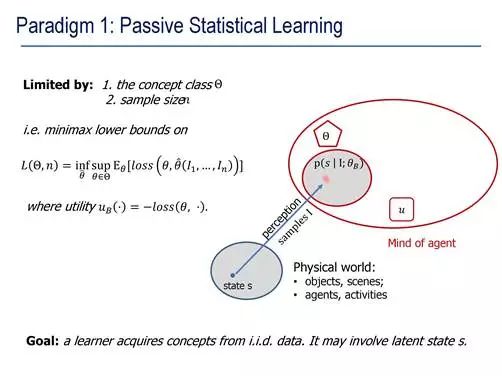

��ǰ������Ļ���ѧϰ����ʵ��һ��������Ķ��壬������������ѧϰ���̡�����ͼ�� ���Ͱ���������

��1���㶨��һ����ʧ����loss function ����u������һ��С����������ʶ�𣬶��˾ͽ���1�����˾���-1��

��2����ѡ��һ��ģ�ͣ�����һ��10-��������磬�����м��ڸ�����theta����Ҫͨ����������ϡ�

��3�����õ��������ݣ�����������˸������˱�ע�����ݣ�Ȼ��Ϳ�ʼ��ϲ����ˡ�

�������û�������û�л������ж����Ǵ���ġ�������ͳ��ѧϰ��Ŀǰ��Щ���Ӿ�ʶ�������ʶ������һ�ࡣ

��ʵ������ѧϰ��һ�������Ĺ��̡� ���������ѧ���ĶԻ������ǽ�ѧ��Ҳ������һ�����̡� ѧ����������ʦ����ʦ��ѧ������ͬ˼������һ��ƽ�Ƚ�����������ͨ�������⺣����Ѽʽ��ѵ����̹��˵������Ȼ�ǽ��ڣ����ھͳ������ҵIJ�ʿ������ѧ����֪ʶ��

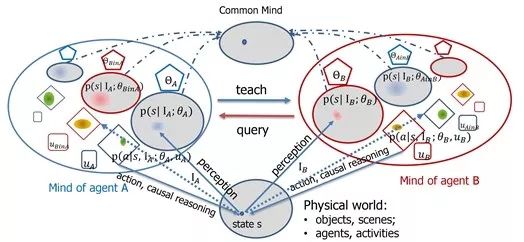

���ѧϰ�����ǽ�������֪����֮�ϵģ������ڽ����Ĺ��ܣ����Ұ����ֹ����ѧϰ����ͨѶѧϰCommunicative Learning������ͼ��

���ͼ������������A��B�Ľ�����һ������ʦ��һ����ѧ������ȫ�ǶԵȵĽṹ�������˽���ѧ��һ��ƽ�ȵĻ������̡�ÿ����Բ����һ���Դ�mind��������������飺֪ʶtheta�����ߺ���pi����ֵ����mu������µ��Ǹ���Բ�����������磬Ҳ���ǡ��ϵۡ��Դ�����֪���Ķ����������м���Ǹ���Բ����˫����ɵĹ�ʶ��

���ͨѶѧϰ�Ĺ������棬�Ͱ����˴�����ѧϰģʽ��������������ѧϰģʽ��ÿ��ѧϰģʽ��ʵ��Ӧ��ͼ�е�ij����������ͷ���������滹�кܶ�ģʽ���Կ���������

��1������ͳ��ѧϰpassive statistical learning������ո�̸���ġ���ǰ�����е�ѧϰģʽ���ô��������ģ�͡�

��2������ѧϰactive learning��ѧ����������ʦ����Ҫ���ݣ�����ڻ���ѧϰ����Ҳ���й���

��3���㷨��ѧalgorithmic teaching����ʦ��������ѧ���Ľ�չ��������Ȼ���������������ѧ�����dzɱ��Ƚϸߵġ�����������ʦ�Ľ�ѧ��ʽ��

��4����ʾѧϰlearning from demonstration�����ǻ�����ѧ�����泣�õģ������ְ��ֽл�������������һ��������ģ��ѧϰimmitation learning��

��5����֪���ѧϰperceptual causality�������ҷ�����һ�֣�����ͨ���۲������Ϊ�������������Ҫȥ��ʵ����֤��ѧϰ���������ģ�ͣ�����������֪��ʮ���ձ顣

��6�����ѧϰcausal learning��ͨ������ʵ�飬 �������������� ���õ����ɿ������ģ�ͣ� ��ѧʵ������������һ�ࡣ

��7����ǿѧϰreinforcement learning������ȥѧϰ���ߺ������ֵ������һ�ַ�����

���ڵ�һ��̸���������ѧϰֻ���������ѧϰ���������С��һ���֣���ѧϰ�����˹���������һ���������ԣ������ѧϰ��ͬ���˹����ܣ�������������졢�Թܿ�����

��Σ�ѧϰ�ļ�����ʲô��ͣ��������ʲô��

���ڱ�����ͳ��ѧϰ���������кܶ���������������ߴ����ʵ����ޡ���������˵��ѧϰ�ļ���ԶԶ��Խ����Щ���塣����ָ��������ѧϰ�����ܷ��������������ģ�ѧϰ��ͣ�����⣬�������ѧϰ������ô��ֹ�����⡣����Щ���⣬�Һ���Ӣ������дһ���������¡�

����ѧϰ��̸���Ĺ��̣���ʵ����ij����Ϣ����Щ��Բ֮�������Ĺ��̡���ôӰ��������������ؾͺܶ�,���оټ������¡�

��1������ѧ�Ķ�������ʦҪȥ��ѧ��һ��֪ʶ�����ߡ���ֵ������������ȷ���Լ�֪������ѧ����֪������¡�ͬ����ѧ��ȥ����ʦ����Ҳ������ʶ���Լ���֪�����������ʦ֪������ô��һ���ؼ��ǣ�˫�����Լ��ͶԷ���һ��ȷ�Ĺ��ơ�

��2������ѧ�ķ����������ʦȷ֪��ѧ���Ľ��ȣ��Ϳ���ȷ���ṩ��֪ʶ�������ظ�������algorithmic learning �� perceptual causality��������ԡ�

��3���������⣺���ȥ����һ�����������̣��ܶද���Щ��������ô�̶��̲��ᡣ

��4����ֵ������������ijЩ֪ʶ������Ȥ���ǿ϶�����ѧ����ֵ��������ˣ��Ǹ�����������������̸�������ѧϰ�ˡ�������Ⱥ�����е��˾ʹ����ˣ���Ⱥ�ˣ���Ϊ�����㲻һ������������һ��ȥ�����ͬһ��Ⱥ����������һ��ȥ�ˣ�������ǿ������ij�̶ֳ�����������ķ��ѡ�

���ѧϰ�������趨������ͬ������ѧϰ�϶�����������ͬһ���ط����й�14���ˣ���14�ڸ���ͬ����ģ�ͣ���14�����м䣬�ֲ�����һЩ��ʶ��Ҳ���ǹ�����ģ�͡�

��˵��ͣ�����⣬���������̬����������ɵĸ���ƽ��̬��

��ʮһ�� �ܽ���ܿ�ѧ --- ţ��������������ϵ��ͳһ

���ˣ���ժҪ�������˹����������������һЩǰ�����⣬ϣ��������ҿ���һ�����µ����������磬�������У�������һ����ͬ����֪��������������ͳһ�������кܶ༤�����ĵ�ǰ�ؿ��⣬�ȴ�������ȥ̽����

��ô�˹����������������߽С�ս�����ۡ�����δӵ�ǰ�ֺ��Ĺ���ʵ������Ϊһ�ų���Ŀ�ѧ��ϵ�أ����˹�����Artificial Intelligence��� ���ܿ�ѧScience of Intelligence�����߽� Intelligence Science�����ͳһ�Ŀ�ѧ��ϵӦ����ʲô��

ʲô�п�ѧ������ѧ������Ϊֹ��չ��Ϊ���Ƶ�һ�ſ�ѧ�����ǿ��Խ������ѧ��չ����ʷ�����Լ��ر�ϲ������ѧ��1986�걨���пƴ��ʱ������д��־Ը���ǽ���������4ϵ��������־Ը�Ժ��Ҿͻ�����ȥ�ˡ��Ҹ�統ʱ������ĸɲ�����ȥ���в鿴�ҵ�־Ը��һ��������������ֻ�½��������ҹ����������Ҹı����������ʱ���Ƕ�û�������������Ҳû�����������������������ײ����������˵�רҵ���������������������ѧ֮����

�ȵ���ѧ���ϡ���ѧ���ۡ��ĿΣ��̲��ǵ�ʱ����У����д�ģ�������Ͳ��������ˣ���Ҷ�֪�������ǿƴ���һ������������ļ��䡣������ĵ�һҳ���Ҿͱ����۵��������ˡ�������һ����ͼ�������ص����仰���������¡�

��1������ѧ�ķ�չ����һ�������������ͳһ����ʷ����һ�δ��ͳһ����ţ�ٵľ�����ѧ�� ͨ��������������������˶������Ŀ��Ƹ��ӵ������˶�����һ��ͳһ�Ľ��͡��γ�һ����ѧ����ϵ���Ӵ�Ҳ�ᶨ�˴�ҵ����

��������������������������������

����ѧ�����ξ���Ѱ��֧����Ȼ���������ͳһ������

����ȫ��һ������������ˣ���Ϊ��Ŭ������ţ��������300�����ˣ�����ѧ�һ��ڷܶ���������һ�����������ģ�͡�

���������ѧ����̾���ǣ��˹����ܵ��о�����ĿǰΪֹ�����ٹ�ע�����ѧ�����⡣�����Ĺ���ѧԺҲ����������飬���æ�Ž�һЩ���ܡ����һЩС���⣬���Ӿ��ܹ��ú����80�����Щ֪�����ڹ���������������ô���ӣ�������������ͳһ�Ľ��ͣ��������ǡ�a bag of tricks��һ����Ĺ�ơ���һЩ������������ˮ�����ڡ��Ĺ��̷�������ˡ��Ȼ�Ƿ�dz�Ͷ��ӵġ�

�ҵIJ�ʿ��ʦMumford1980����Ӵ���ѧת��ѧϰ���о��˹����ܣ�����������Ϊ���ܹ���һ����ѧ��ϵ��mathematics of intelligence��������������������ת���Ǽ��䲻���ģ����кܶ����˵�ͷ�Σ������ƶ��Ƚ�����˰�ɪ��Ž���������ѧ��Э����ϯ���������ҿ�ѧѫ�£��� ���ҵ�Ŀǰ��û�м����ڶ�����ôת�͵Ĵ�ҡ� 1991���Ҷ����ѧ�������о���Ժ�ĸ��˳�����Statement of Purpose���о����¶��������Ҫ̽������һ��ͳһ��ܡ���ʱҲû�л���������Ҳû����˵��Mumford���ǵõ�ʱ�ƴ�����ϵ�ո����˵�һ̨�����ӡ���������ʽ��ӡ�������������������롱���̸��ܻ�����ʦ�֣�����һ��Ҫ���Ұ�����ҳֽ�ĸ��˳����ú��Ű桢��ӡ�������������ѧУ���ܾ����ҵ����룬���ҵ�ʦ����¼ȡ���������ʿ��ͬһ�꣬ �ƴ�����ϵһ��ʦ����Ӣ�걻¼ȡ������ͳ��ѧ���������Ǿͳ������ѡ�����������ͳ�Ƶ�����ʮ����̣���ȥ25������һֱ��һ����������ڻ�ͷ���������������գ�

��2������ѧ���������־�ų����о�֮�⣬�������������ܿ�ѧҪ�о��Ķ������ܿ�ѧҪ�о�����һ�������������ϵĸ���ϵͳ��������Ϊһ�����ͱ����ڸ�������Ȼ�����Ⱥ�������ú���Ϊ�����С��Ҹ���������Щ��Ϊ�������Ȼ��ͳһ����������á�����Ԫ������������ʵ��Щ��������Ǹ������Ӿ�������˵һ��Ҳ��İ�������ǵ�ģ��������ģ������ȫ��ͨ�ģ�������һ�����ʷֲ���������ˡ����ܺ������������˸��֡�����á��� Ȼ������˸��֡������롰������

��Щ���������ǰ��û�����������о��ģ�������˹̹���ġ���������һ����������һ����ѧѧ�ɳ������������ѡ��������ڿ����ˣ���ǰ���Ѿ�������һЩ���ӣ� �Һ��ҡ������ӡ����·������ǿ��Դ������������������õ��������ڽ����˵ĸ�����Ϊ���������������ѧ��л������������á��������ͳ����������˵�����ã� �滹����2017�������֪ѧ���һ�������㽨ģ������ �����Ժ��д���½����ⷽ��Ĺ�����

���ܿ�ѧ�ĸ���֮�����ڣ�

��1������ѧ��Ե���һ���۵����磬�����������ӳ�䵽ÿ�������У� �γ�һ����������ںϵ����磬Ҳ����ÿ�������е�ģ�ͣ�����ͳ���б�Ҷ˹ѧ�ɹ۵㣩�����ģ���ֱ�ӳ�䵽�����Դ�֮�С�ÿ����Mind����������ϰٸ����˵�ģ�͵Ĺ��ơ� ����Щģ���������˵��˶�����Ϊ��

��2������ѧ���Ѹ��������������о���������һ��ͼ��Ͱ���������ģʽ�� �˵�һ��������������˺ܸ��ӵ�����������Ѹ��뿪�����ң���ǰ�Դ����ݼ�Ϊ���ݵġ����ѧϰ��ѧ�ɡ���ˢ���ɡ��dz����У���Ҫ��һ��С���ⵥ���ó����о����������Ǹ������ݼ��������ֲ���ʲô���˵ġ������͵��������ϣ����Ǿ͡�ǿ�Ҿܾ�����Ҫ���㵽�������ݼ����ܽ����������ȱ����ѧ��˼ά���������غ����գ�

�ص�ǰ����ѻ�����ӣ����ڵ��Ľ����۵��������о�������������ϵͳ����������ǰ�

һ���������������������������ֵ������������������ġ����衱���������Ϊ���DZ��������������ģ������ɼ�ֵ�����������������ǽ������е�phenotype landscape��ͨ��˵���ǽ������������档����Ľ������������������������û�и�����ѧ������������ҷ��֣�����ͻ����ʵ������������������ġ���ʱ��߶��ϵļ�ֵ�����е��ж�action����ǰ���Ǹ����·��ļ�ֵ��������ͼ�����Ǵ�����ѧ�����ġ�

�������������۵���ʵ������������������Ȼ�߶��µ��������������������Ҳ����ţ����ѧ�Ķ�����

˵���ף��˹�����Ҫ������ܿ�ѧ���������ϱؽ��Ǵ������ţ��������������ϵ��ͳһ��

2016���ҵ�ţ���ѧ����Ŀ�����ᣬ˳��ι����ص�Westminster Abbey ����á� ���Ҿ��ȵ��ǣ�ţ�٣�1642-1727�������ģ�1809-1882�����˵�ĹѨ���Ҳ��2-3��Զ��վ���Ǹ��ص㣬�ҵ�ʱʮ�ָп��� �������˿���˵�dz��ı���������۵ġ���ΰ��Ŀ�ѧ���ˣ���������ΰ���������ϵ��˼���ͳһ����Ҫ�ȶ���أ�

��ƪ���ĵijɸ�������������������ƴ�ʫ���������ġ���ʡ�������˵�����е�һ�־��磬���ҹ��ͣ�

���Թŷ��ﱯ���ȣ���������ʤ������

���һ�������ϣ�����ʫ�鵽��������

��¼

�п�Ժ�Զ����о����ٰ�ġ��˹�����ǰ�ؽ�ϰ�ࡪ�˻�����������Ļ�����¼���������棩��

ʱ�䣺2017��9��24������

�����ˣ� ���̺���ڽ��ܴǣ���л����֮�ʣ��ڴ�ʡ�ԣ���

�� �����ף�

��л̷��ţ��ʦ��ι��պ����̺���ʦ��ʢ�����롣�����������죬�dz�������˼����������Ϣʱ�䡣��֪�����ƽʱ����æ�����Ǽ���������һ�����dz������ס����ԣ��Ҹ����Ǵ���һ��ɻ�����Ϊ����������

����Ľ����Ǹ��������ģ�����ʦҪ��̸�˻�����������ʲô���˻���������Ҫ�����Щ���⣿�Ҿͻ���һ��ʱ��������һ���Ƚϳ��Ľ���������ҽ����˹����ܵķ�չ�����˻���������ϵ�ṹ���������dz������о������ո��������Ҫ�Ѻܶ��������һ�����ܿ������µ��������Ҹ������һ��˼·���������˼�����Ҳ�����ֱ�Ӹ���һ������������Ļ��Ͱ���������˼���Ŀռ��Ȩ����

2017������ڡ��Ӿ�������������һƪ̸��ѧ�������������£�������ѧ�ʵ�һ�����뾳����ǡ�������¡���Ҳ����ҹ���˾���ʱ����ȥ��ѧǰ��̽������������Ľ�����ϣ���Ѵ�Ҵ�����ôһ���տ��ĵط���ȥ����һ����

���������ʻ�����

����һ������ʦ��������ôͨ��ѧϰ��������������ʶ���ղ�����ʾ���Ǹ������ˣ��ſ��и�����Ҫ������Ta��ô֪���Լ����˰�·���ó�����

�죺������ʶ�������dz���Ҫ�����ȼ�Ҫ����һ�±������ٻش�������⡣

������ʶ��self-awareness��consciousness��������ѧ��������ܴ���������֪ѧ��һ�Ȳ��������ȥ̸������⣬���������˶����ò����о����ѡ��˹�������������������̸�����ǣ�������ء�������ʶ�������㣺

��1����֪���顣���ǻ�Ǯȥ����Ӱ������ɽ�������Σ���ʵ��ľ���һ�����顣����������һ�ֱȽϵͲ�ε�������ʶ���γ�һ�ֱ�������������潲���Ľ���ͼ���� �º���Ҳ���Ի�ζ��

��2���˶����顣������Ȼ�о��ӣ����dz����赸��Ա����Ҳ�û�п����Լ�����Ϊ���������ǣ� ���Ƕ��Լ�����̬�Ͷ���������֪�ġ�����ʱ��֪�����ǵ���̬����ά���������磬����ѧʵ�飬�����һȺ�ˣ���Ϥ�Ͳ���Ϥ�Ķ��У��Ķ�����̬�ü����ؽڵ����˶�������¼������Ȼ�Ͱ���Щ��Ÿ��㿴����ֻ��������˶���������������Ϣ�����ϳ��ĸ��������Լ��ı��ʸ����ϳ����ˣ����Ҷ��ӽDz���ô���С����ԣ�����ͨ����֪���˶��ڹ�ͬ����һ�����ҵ���άģ�͡��������ǻ�ͨ�ģ����������ھ�����Ԫ��mirror neurons���������ڲ������һ���ؼ�ת�����ơ�

���������ⷽ��ͱȽ�����ʵ�֣������Լ�����άģ�ͣ��ؽ��д�����������Visualodometry�� ����ʱ�����Լ��ڳ����е���άλ�ú���̬����һ�㲻�ѡ�

��3����֪֮�����й��и�����������˹�����֪֮���������仰˵��һ���˺�������֪֮�������Լ���������ʶ����Ҫ�ָ��۵͡������۸��ֵ͡�����������ʶ��Ҫ��ʱ���µġ����磬�Ⱦƺ��ܿ������ƹⰵ��ʱ���ҵ�����ʶ�������Ͳ���ôǿ����������Լ������仯��һ���жϡ�����ÿ���������ܶ���һ����ʵ������൱�����ˡ�

���磬�����˽����ձ��������ֳ������˷�����ʱ���������˵ĸ���������ͻȻ����һ����·��ͨ�ˣ�һ���ؽ��˶������ˣ�һ���ڴ汻�ƻ��ˡ��������Լ�֪�����������µ����Լ�������滮��Ŀǰ�˹�����Ҫ������һ�㣬�dz��ѡ�

�ղ�˵���˽�����������֪�������ˣ��Ǿ���һ��Э�������Ĺ滮����滮����������Ҫ֪���Է���ʲô���������磬���������־���ʵ�Ƿdz����ӵĻ������̡�Ϊ�˴�����Ŀ�꣬��Ҫ��������ģ��simulate��

���ʶ���лл����ڣ��о����������Ķ�������ǰ����û�������Ķ���������һ��������������������������ʶ�����ѣ�����˵�Ľ�������Ҫȥ����Է��Ǹ��˵��뷨��������Ϣ����ô����ȡ�أ�Ҳ��ͨ��ѧϰ���ǣ�

�죺���۲���ʵ�����㿴����������۲쵽������ܹ�ѧ��ÿ���˶���һ���ļ�ֵ����������˽����Χ��ͬ�£��������ǹ���һ���칫�ң����߹۲����ͥ������ˣ�����������ʱ��Խ�������Խ��Խ���֪������ô�����⡢��ô���£�Ȼ��������ڽ����Ĺ�����Խ��ԽĬ���ˡ����˹۲죬����ʵ��������ȥ��̽������Է�������֮�䣬�ս��ᳳ�ܣ�֮��Խ��Խ���ˡ���г�ˣ���ֵ���ںϴ��������ˡ������ܹ����������ˡ�ʵ�����������Ǿͷֵ����𣬵������ְ����������������������˵�ġ�ѧϰ��ͣ�����⡱�����֮�䲻Ҫ���������ѧϰ�ˣ�Ҫô������ᡢ���ղ�����Ҫô������š���ͬİ·��

����������Ҳ��ͨ�����Լ��۲쵽�������潨��һ��ͼ��һ������ͼ��parse graph����

�죺���ҿ����������ġ������ұ�������Դ�����ĺܶ�ṹ�����ع����������������ǽ���ͼ�����������������Ԫ����洢�������ͼ�����Dz���������Կ϶������Ƶı�����Դ���������ı�����ҾͿ���װ��������ĶԸ�������ķ�Ӧ��

��ѧ���Ҵ�����ʱ�����Դ�����ͬʱҪװ�¼�ʮ���ϰٺ��˵�ģ�ͺ�֪ʶ�����Щ��֪��ʲô��ʲôʱ��֪���ġ����ĿƵ���һ��۲�Ƚ����������������ⷽ�������϶�Ҳ�ر�ǿ��

�����ģ������ǸսӴ�����ѧϰ������û��ʲô�Ƽ��ģ���Ϊ���ڴ�Ҷ�����ѵ��������磬��û��һ���Ƽ��ģ����Ǹ���ģ�ͻ���ʲô������һ����ѧ���ۻ���һ����ѧ���ߡ�

�죺�ҵ��뷨�������ģ������ô�Ҷ���˼�룬��������ѧ��̽��������δ֪������˵��ҹ���˾���ʱ����̽�������������ľ���������������Ȼ�Ϳ���һЩ���˺��ԵĶ�������Ҫ�����Ƽ�ij�����ߡ����롢�ؼ����������á��ҽ��콲�Ķ�����������Դ��ijһ�����ۡ����ߣ����ڻ��ͨ��Ľ����

�ҷ������ѧ���ǣ�����ѧ�о����ǹ�ȥ���ֵ��������ſ���Ϸ���������־��������ꡣ����ǰҲ̸����һ����·�Ƶ�����������ѧ�о�������һ����ڵ�ҹ����Կ�ף����ϲ������·�Ƶ����ң����Ǻܿ���Կ�ײ����Ǹ��Ƶ��¡�

�����壺����ʦ�ã��dz���������������棬�����һ������ܼ���˵�Ǽ���ʱ�ڣ�������һ���س�����ʲôʱ���ܵ������س���ʱ����ѧ����һ������Ϊ�����ܻᱻ�����س��������������������Ǹ�������ʲô��

�죺�ʵúܺá�ʲôʱ���ﵽͳһ����������й�������˵�������е�����

һ��˵����������ɽ������������ԶԶ����ǰ���Ǹ�ɽ�쵽�ˣ������ǰ�У������������������ˣ��м���ܻ��м�������סȥ·���������Ƕ����������Ʋ��㡣

�ڶ���˵���ǡ�Զ����ߣ�������ǰ���� �ܲ��ܵ������������ߵ��˵��ǻۺ��ж���ʲôʱ��ͳһ��˭��ͳһ��������������Լ�Ŭ���ˡ������ս��ʱ�ڣ�˼��������ģ����Ӱټ�ȫ���������ˣ�����һ��˼�뼤����ײ��ʱ�����ҽ��콲����Щ������ʵ�������Դ����漤�ҵ���ײ���һ���Щ�����벻ͨ��

��������̸�������Ϳ�ܣ�������������ж������������ҵĹ۲��ǣ����٣�Ҳ��һֻ�־Ϳ������ù�����

��ĵڶ������⣬���Ҫͳһ��������������ѧ������ʲô������Ҫ����ͳһ��֪ʶ������ʺ���Ҫ�ںϣ������ѧϰҲҪ�ںϡ����ǿ�������ѧ�����ͳһ�ģ������������ģ�ͣ��Ĵ������������ã�������Ǣ��Ȼ�����������˵������Ҫ��������㣺

һ��ʲô�ط���ʲôģ�ͣ� �ԱȾ�����ѧ�����ѧ����ѧ��ͳ�����������������ȶ����Լ��������ɺ�ʹ�÷�Χ���������Ҳ���ƣ�����ģ�������ǵķ�Χ�ͻ������������dz�����˵�ģ�����˹ģ���������ڸ�������ϡ��ģ���ڵ����������ͼ���������������һ������ҵ�ʵ���ң�������û���������о���

������Щģ��֮�����ת���� ǰ���ҽ���һ�����ӣ���д��һƪ������ʽ�������Ʒ�����ʽ��ϡ�裩ģ�͵�ͳһ����ɵ���Ϣ�߶ȵ����ģ�Ͷ��CVPR���飬��������������ǡ���5��ǿ�Ҿܾ�����5��ǿ�Ҿܾ�����4���ܾ�������Ҹ�����û��������⣬�۾����Ͱ͵ؿ������ݼ������������˶��١�ˢ�����CVPR���е���Ҫ��ʽ����ijЩ�����У�ˢ�����Ψһ��ʽ������ǰ�������������������һ�룬��ʵӦ�ö�������Ҷ���Щ�Ѵ��ڴ�������ȥ��ѧ����������ǰ���������������ر�м�Ta�ǡ��������Լ���ѧ�����и���ʱ��ȥʵ�����ǵ�˼·�����Ƕ�һ��ӿ������̤���ҿ����ڣ��Ҷ��㲻���������о�ϲ���徲����ȥ�����֣���ȥ��������������Щָ�ꡣ

���̺�����ܽᣨ����������������ڵı��棬��ҿ��Ըо������㡣

һ���ݺ����ء��������ᡣ���ۡ����������˹�������������ܶ���̵���Ŀ���ںܶ�������ݺύ����ߣ������÷dz�������������ᣬ�շ����硣�dz����������������ı��档

������������������㡣�����������ȥ˼�����⣬���ȥ�����磬����о�һЩ�������ʵĶ��������������ѧϰ������ǿ��֮���кܶʿ������һЩ�о��߹����������ߣ�˼�������������ˡ���ʵ�о���������ô����һ��Ҫ̧��ͷ�������������ǿա�

��л

��л���о�Ժ�����������ա�������Ȳ�ʿ2016��9���ڱ�����֯�����ֻᡣ2017��6������Ÿ�������ա��ւ��Ƚ�����������������Ĵ�ѧ�����ı��档������ʿ��2017��7������ͼ��֯�ı̻���̳��2017��9����̷��ţ���ڹ����¡����̺�������п�Ժ�Զ������ٰ���˹������˻�������ϰ�ࡢ��ָ���ټ�Ա�ͱ�����ʿ��������ͬѧ��������������ij��塣����û�����ǵ����ġ��ߴ١�������Э������ƪ���ı����Dz����ܲ����ġ������еIJ���ͼƬ��VCLA@UCLAʵ���������Ρ�κƽ�����������Э��������

��л�пƴ���ҫ�ӽ��ڡ���־��ͬѧ�����ҵ��DZ���صġ���ѧ���ۡ�����ɨ��档�����۱�ժ¼�����С��ҵ�˼���ܵ��Ȿ������ɡ�

��л���Ӿ����������ںű༭�����ٻ������ա���۫���ܲ���ͬ�ʵ�Э����

��л������һ����������ἰ�о��ij���֧�֡�