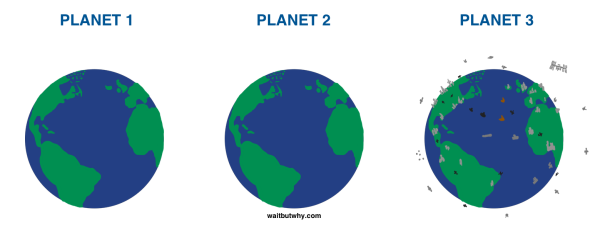

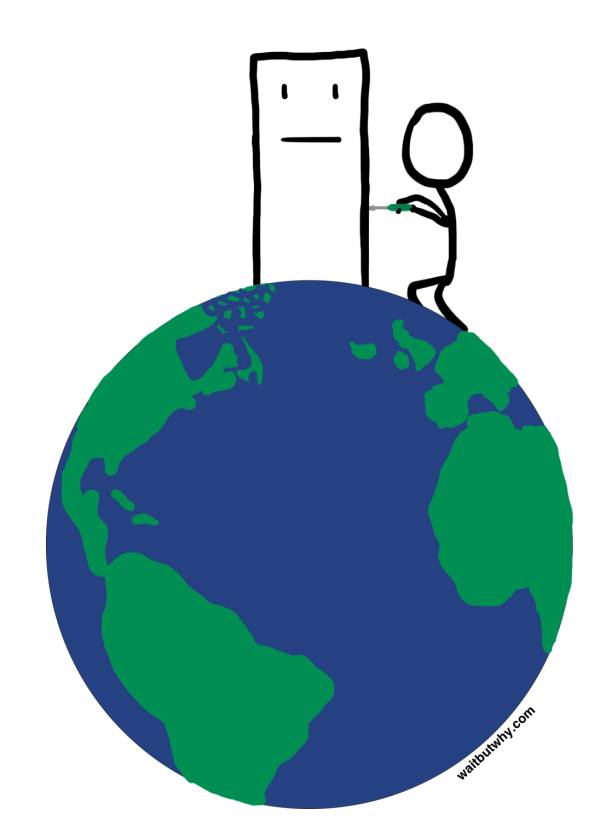

想象一个外星探险家正在探访一颗新的恒星,发现它拥有三颗行星,并且上面都有生命存在。其中一颗正巧处于公元前一千万年时地球的状态,一颗处于公元前五万年时的状态,另一颗则与 2017 年的地球相同。

探险家不是原始生命方面的专家,但依然盘旋在三颗行星附近,通过望远镜观察着每一颗行星。在行星一上,他看到了大片水面、大量树木、山脉以及少量生命的痕迹。他还发现了一群大象漫步在非洲大陆上,一群海豚在大洋表面反复跃起,以及其他一些零星的人散布在各处。

然后他转去观察行星二。人更多了,除此之外区别不大。他还注意到一个不同之处,星星点点的光芒不规则地散布在大陆上。

感到无聊后,他又去观察行星三。哇喔。他看到地表上方有飞机来回穿梭,大块灰色陆地上建筑物高耸入云,大洋上零星航行着各式船只,长长的铁路横跨各片大陆,而且他还需要操纵飞船避开掠过的卫星。

当他回到故乡后,他会这样报告自己的发现:两颗行星上有原始的低等生命,一颗行星上有智慧生命。

你能明白他为何会得出这些结论――但是他的结论是错的。

实际上,与其他两颗不同的是行星一。行星二和行星三上都有智慧生命存在――相同的智慧生命。他们完全相同,以至于你在行星二上拐走一个婴儿,将其与行星三上的一个婴儿调换,之后他们都能像正常人一样长大,并完美适应环境。他们毫无区别。但是,这怎么可能呢?

人类巨像。这就是原因。

你是否曾好奇过,为何你平时只看得到周围人的平庸,但又惊异于人类的成就?

这是因为,实际上,人类现在仍相当于行星二上的人。

把一个人类婴儿交给一群黑猩猩抚养,像泰山那样,这个婴儿长大后就能在森林中奔跑、爬树、寻找食物,以及自慰。这样的存在是本质上的我们。

另一方面,人类是个拥有超常智慧、渊博知识、数千年历史的巨大集合体,还各自拥有 75 亿神经元。这样的存在建造起了行星三。

语言的发明使得每个人都能在死前将自己的知识存入一个集合,这个知识集合像一座高塔一样越来越高,并最终作为人类巨像的大脑为我们建立起整个文明。自此之后人类巨像便开始不断地创造,并随着时间的推移越来越擅长。在创造价值的欲望驱动下,人类巨像来到了一个史无前例的阶段,这也是为什么我们正活在一个史无前例且极其特别的历史时期中。

你知道为什么我说我们可能正处在两个沟通时代的临界处吗?

事实是,我们似乎正处于众多历史变革的前夜。在十万年的人类历史及 38 亿年的地球历史之后,这个世纪似乎将是地球生命从单行星纪元向多行星纪元飞跃的世纪。这个世纪可能是地球生物最终成功在自然演化之外主动编译基因的世纪。现在的人们将能见证人类寿命摆脱自然的意志,并由人类自身意志掌控的时刻的到来。

人类巨像的能力已经到达了一个全新的层次,这种能力足以颠覆之前的 38 亿年历史,并使我们迎来众多惊人变革的临界点。而一旦我们的外星朋友发现了碰巧与 2100 年地球相同的行星四,它看起来绝对与现在的地球完全不同。

我希望大家都充分享受过了行星三的好处,因为我们即将离开它。我们将前往行星四,不管我们是否喜欢它。

如果要我来总结伊隆・马斯克所做一切的背后动机,那么它其实很简单:

他想让我们为移居行星四做好准备。

他所看到的是整个大局,且只关注最宏大的大局。这就是为什么他的视角如此与众不同。这也是为什么他感到如此焦虑。

不是由于他认为行星四很糟糕,而是行星四有可能很糟糕,并且他明白不管我们这一代人是否已经意识到,我们都将是面对真实而残酷的生存危机的第一代人。

与此同时,我们是有切实希望迎来真正乌托邦式未来的第一代人――这个未来里甚至可以公然挑战死亡与税收。行星四可能会是我们的世外桃源。

如果从宏大的视角去思考,你会意识到这份赌注无比之高。而且回报并非纯凭运气――得看人类巨像接下来的发挥。行星四只会被人类巨像自己造出来。并且是天堂还是地狱取决于人类巨像接下来会怎么做――也许是接下来 150 年,也许只是接下来 50 年。或者 25 年。

但不幸的是,人类巨像并不擅长把「将尽可能多的人类转移到一颗尽可能好的行星四上」的机率最大化――它擅长用任何办法,尽可能快地造出行星四。在充分理解这些的基础上,伊隆一直致力于使人类巨像的前进方向更符合人类的长远利益。他明白重塑人类巨像是不可能的――除非生存危机突然变得迫在眉睫,通常这种情况出现就晚了――所以他拿巨像当宠物来对待。

如果你想要你的狗坐下,你会把坐下的命令和给它的狗零食联系起来。对于人类巨像来说,「狗零食」是一个新产业同时在供需两端急速爆发。

伊隆看到人类巨像在不断将深埋地下的远古碳元素释放到全球碳循环中,就像狗在地板上撒尿一样,并且他不打算用语言的方式劝巨像停止这么做(有很多人在这样浪费口舌),或是尝试逼迫巨像改变做法(政府在努力这样做,但成效有限)。他打造了一种酷炫的电动汽车,拉风得让每个人都会想要一辆。汽车工业看到了消费者偏好开始转移,所以在特斯拉发布第一辆汽车之后,旗下有电动车系列的主流汽车厂商从数量为零变成了几乎所有。人类巨像似乎吃下了这块「零食」,而且在行为上有所改变。

伊隆发现,尽管各种引爆点即将到来,人类巨像依旧把所有生命的希望都保存在一个星球上,就像小狗跑进车水马龙的马路上一样,于是他创办 SpaceX 研究火箭着陆,这会让太空旅行的成本降低 99%,所得到的成果则成为给太空产业的巨大贡献。他的火星计划不是告诉人类说,在火星建立新文明作为人类种族延续的保障是正确的――而是去发明一种可来往于火星和地球之间的廉价货船,这样就能保证一旦灾难来临,开发火星会有足够的机会创造价值,人类也会下决心抓住这些机会。

但是对伊隆来说,人类巨像最可怕的行为是教计算机巨像思考。对伊隆和其他很多人来说,长远来看,超级智能的发展会是人类最大的生存危机。不难看出这里的原因。智力赋予我们人类远超地球上其他动物的神一般的力量――这对其他生物来说可不是好事。如果它们身体的任意部位有利用价值,我们都有对应的方式处理和出售它们。有时我们出于娱乐猎杀它们。但我们很可能感受不到乐趣,我们只是在做自己的事,基于我们自己的理由,不带有仇恨或伤害他物的欲望,只不过一些生物或生态系统碰巧挡了我们的路,或者不幸受到我们造成的附加伤害。人们时常对人类这种做法感到愤怒,但实际上,我们只是在做所有生物都会做的事――优先利己。

其他生物的麻烦不在于我们的利己――而是我们的利己能对它们造成巨大伤害,因为我们的力量远超过它们。这份力量来自我们巨大的智力优势。

所以对于刻意发明某种智力(可能是远远)超越我们的存在,保持警惕是相当合理的――尤其是考虑到对于这件事,世界上所有人都是外行,毕竟之前可从未有人做成过这种事。

而且这方面的进展相当迅速。伊隆是这样评论谷歌的下棋 AI 的飞速进步的:

我是说,你已经了解到这两件事,AlphaGo 正面击败了这些人类棋手,4:1 击败了李世石,而现在它将能击败任何一个人类,而且在此同时和 50 位顶尖棋手对弈,并反复击败他们。这应该也就是一年以后的事吧。

而且这种情况现在只发生在一些无害的事情上,比如下棋。但 AI 超越人类的领域还在不断增加。相比国际象棋,围棋要更加复杂,但如果你和 AI 比试复杂度远超围棋的《英雄联盟》或 DotA 2 这样的即时战略对战游戏,AlphaGo 暂时还赢不了。但将来它会的。然后下一关便是「现实世界」这个具有终极复杂的系统。

基于以上原因,他对这些事情感到担忧:

近些年,就是最近这几年,我意识到很显然 AI 将在智力上大大超越人类。……在这一时间点上有可能会发生一些不好的事情,一些我们人类不能在它发生后掌控的事情――要么是一小部分人垄断了 AI 的力量,要么是 AI 变得残暴起来,或者类似的情况。这可能不会发生,但也可能会。

但是在典型的人类巨像体系中,「集体意志并不理解 AI 的危险。」

当 2015 年我采访伊隆的时候,我问他是否会努力参与创造超级 AI。他说,「我的真实观点是我们不应该创造超级AI。」之后当我表示,建造一个比你自己还聪明的存在看起来像是个基本的「达尔文错误」(这是我从 Nick Bostrom 那儿借来的词),伊隆回答到,「我们会集体赢下达尔文奖的。」

现在,两年后,他是这么说的:

我曾努力了很久,让大家警惕 AI,但很显然这么做毫无效果(大笑),于是我就像是,「好吧,那我们就只能努力让它往好的方向上发展了。」

他接受了现实――人类巨像不会停手,直到某天计算机巨像觉醒。这即将发生。

不管人们是怎么说的,没人知道当计算机巨像学会思考时会发生什么。在我的文章《Long AI Explainer》中,我分析了两种观点的来源,一种观点认为超级 AI 将是现存所有问题的解决方案,一种观点认为人类就像一群小孩子,玩着自己也不理解的炸弹。我个人仍然不清楚到底哪种观点更有说服力一些,但理性的做法应该是为最坏的情况做好打算,并且尽一切可能增加我们的胜算。很多专家同意这一逻辑,但对于开发超级 AI 的最安全策略却几乎没什么共识――只有那些很清楚自己不知道答案的人提出的一大堆猜想。有什么人能知道如何防范自己也不了解的未来世界呢?

伊隆也清楚他不知道答案――但是他正投身于一个能带给我们最大希望的计划。

伊隆的计划

亚伯拉罕・林肯写出这句话时是非常兴奋的:

――要使这个民有、民治、民享的政府永世长存。

不错,写得好极了。

整个「民有、民治、民享」的概念便是民主的核心要义。

不幸的是,「人民」是令人不愉快的。所以,民主也跟着变得令人不愉快。但这种令人不愉快与其他选择相比更接近理想境地。伊隆是这样说的:

我认为对集体的保护是很重要的。我认为这就是丘吉尔所说的,「比起所有其他制度,民主是最不坏的政府系统。」如果你拥有一位柏拉图笔下的哲学王式国王,这当然很不错。但现在大部分独裁者不是这样的。他们经常是非常糟糕的。

换句话说,「民主」就像是我们为了躲避一只怪物的袭击而藏身于阴沟之中。

在人生中的很多关键点上,冒一些风险以抓住机会获得最大回报是一种好策略,但当风险高得不能再高的时候,最好的策略通常是求稳。权力就是这样的关键点之一。这就是为什么,即使民主本质上带来相当程度的平庸,伊隆说,「我认为你会很难在美国看到会有人,无论他们对任何总统候选人有怎样的想法,会去为独裁政权投上一票。」

自从伊隆将 AI 视作终极力量,他将 AI 的开发视作终极「求稳」解决方案。这就是为什么为了最小化来自 AI 的生存威胁,他的策略本质上是让 AI 力量变得「民有、民治、民享」。

为了努力实现这种对于 AI 领域的观点,伊隆从多个角度进入了这一领域。

在「民治、民享」这方面,他和 Sam Altman 创立了 OpenAI ――其自我描述为「非盈利的 AI 研究公司,致力于探索和共享安全的通用人工智能技术。」

通常,人类对某种新事物的研究都是从少数前卫先驱者的研究开始的。当他们成功后,相应的产业被建立起来,人类巨像集体借助先驱者的成果踏入这一领域。

但是,如果先驱者在研究的是一根魔杖,它会带给持有者无边的强大力量,超越其他所有人的力量――包含阻止其他人造魔杖的力量呢?这就有点吓人了,不是么?

这就是伊隆如何看待当下 AI 发展成果的。由于他无法阻止人们尝试造魔杖,他的应对方式是创建一个开放、共享、透明的魔杖研究实验室。每当实验室发现一个革命性突破,实验室会将其发表出来,供任何人查看或为用于制作魔杖,而不是像其他公司一样将其当作商业机密持有。

另一方面,这样做也有缺点。坏人也在尝试制作魔杖,而你绝对不想让第一根魔杖出现在坏人手里。现在坏人的研究进展也会受益于实验室公开的新成果。这是个很严肃的问题。

但是实验室同样也促进了数百万其他人创造魔杖的进程。这促使未知的先驱者当中产生了激烈的竞争,并且某个发明者远早于其他人造出魔杖的可能性变得更低了。更可能发生的是,当第一根魔杖最终被造出来时,会同时有成百上千个接近完成的魔杖――不同的魔杖,不同的能力,被不同的人持有,有不同的用处。如果我们注定会在地球上持有魔杖,伊隆认为,至少要确保在世界各地有足够多的人同时持有――而不是只有一个无敌的魔术师。或者,如他所说:

本质上,如果每个人都来自氪星,那就太棒了。但如果只有一个人是超人,而且超人还有着一个希特勒般的人格,那我们可就有麻烦了。

更广泛地说,单独一个先驱者的魔杖很可能是造来服务于创造者自己的需要和目的。但将未来的魔杖产业变成合作共享式的,各式魔杖对应各种需要和目的,这使世界上的魔杖总和将更可能满足所有的大众需求。

就像民主一样,你懂的。

像尼古拉・特斯拉、亨利・福特、莱特兄弟和艾伦・图灵那样领先于所有人做出超前的革新,这没什么问题。但当你面对某种难以想象的强大发明时,你不能什么都不做,完全让先驱者们去搞定一切――这样做风险太大了。

OpenAI 是一种使 AI 的诞生民主化的努力,目的是在拓荒阶段使全体人类都参与到 AI 的开发中去。伊隆这样总结道:

AI 将一定会远远超过人类的能力。根据其契合人类意志的程度,尤其是大多数人类的意志总和,它可以成为大多数人类所想要的成果,因为它会是他们意志的产物。

那么,现在你可能已经确保了早期不低于人类水平的超级 AI 是「民治、民享」的――这杜绝了超级 AI 落到某个单一的坏人手中,或被垄断者严密控制的可能性。

现在,我们面临的问题只剩下「民有」了。

这一点应该很简单的。记住,人类巨像发明超级 AI 和发明汽车、工业机器人和电脑的目的是一样的――作为一种人类自身的延伸去承接我们的工作。汽车代替我们走路,工业机器人代替我们进行流水线操作,而电脑则搞定信息存储、组织和计算。

发明能思考的电脑会是目前我们最伟大的发明――它们将允许我们把最重要和高效的工作外包出去。思维带来了我们今天拥有的一切,所以想象一下创造一个极其智能的思维「延伸」所带来的力量。而由人类自己定义的人类延伸,就是「民有」。

最后剩下这一个问题了――

高水平的 AI 和其他的发明不太一样。我们的其他技术擅长做它们被设计来做的事,但最终它是个不能思考的有限智能机器。我们在努力发明的 AI 会是很「聪明」的,就像人一样――像一个「可笑的」聪明人。它从根本上与我们过去的发明不同――那我们为什么指望既有的规则适用于它呢?

掌控我们自己发明的技术是一件自然而然的事情――这一点明显得完全不需要强调。但如果因为比人类还要聪明,我们造出来的东西可能不容易掌控,这一点还成立吗?

有没有这样的可能,一种造物比地球上任何的人类都善于思考,它可能不完全认同作为人类延伸的工作,哪怕这种工作就是它被设计来做的?我们不知道到底会发生什么――但承认这种可能性存在才是稳妥的。

而如果这种可能性真的变成事实,我们可能有了一个大麻烦。

因为,正如对人类历史的研究所预示的,在世界上出现一种比其他人都聪明的存在,这对所有其他人是一件非常糟糕的事情。而如果 AI 成为了这种比世界上其他人都聪明的存在,且它还不完全为我们所拥有――这意味着它只属于它自己,这会将我们都划入「其他人」范畴。

「多数人」获得对 AI 的垄断控制是人类的内部矛盾――这也是 OpenAI 致力于解决的问题之一。但它跟 AI 不受控制的问题比起来根本不值一提。

这就是令伊隆彻夜难眠的事情。他看到超级 AI 在这个星球上的崛起只是个时间问题――当这一刻到来时,他相信让我们不被划入「其他人」的范畴是件生死攸关的事情。

这就是为什么他认为,在一个由 AI 和其他人组成的未来世界里,我们只有一个选择:

成为 AI。

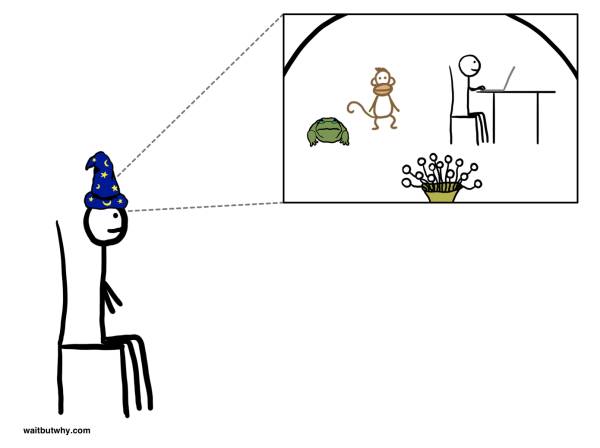

还记得之前我说的,有关巫师帽我们需要理解的两点吗?

1. 这是个很难理解的想法

2. 这是个超级难以理解的想法

2 号帽子就在这里登场。

当埃隆将巫师帽比喻成人脑的「数字的第三层」时,他指的意思就是这两种想法。如前所述,第一个是认为全脑接口等同于把设备放入大脑的概念――实际上这将你的大脑变成了设备。就像这样:

你的设备赋予你半机械式超能力,和一扇通向数字世界的窗户。你大脑的巫师帽电极阵列是一个新的大脑组成结构,参与着大脑边缘系统和皮层的工作。

但是你的大脑边缘系统、皮层和巫师帽只是硬件系统。当你体验着你的大脑边缘系统时,你的互动对象不是物理系统――而是它内部的信息流。出现在你意识中的是物理系统的活动,是它使你感到愤怒、恐惧、性奋或饥饿。

同样的还有大脑皮层,这张包裹着大脑的皮层存储和组织着信息的餐巾。但当你思考、观察、聆听或产生感觉时,你体验的是信息本身。皮层的视觉区域本身对你没有任何影响――其中传输的由光子形成的信息流给了你视觉体验。当你在记忆中搜寻某些东西时,你不是在寻找神经元,你在寻找神经元中存储的信息。

大脑边缘系统和皮层本身只是些灰质。灰质中活跃的信息流形成了你所熟悉的内心人格、本能和理性思维。

那么,这些对你的「数字的第三层」意味着什么呢?

这意味着当在你脑袋中的实际上是物理设备――电极阵列本身时,你所体验和了解的作为人格的「数字的第三层」的部分,其实是电极阵列中流动传输的信息。

正如边缘系统中的感觉和欲望,大脑皮层中的思想和无尽的声音,对你来说都像是你自己的一部分――就像是你的内在精神――你巫师帽中活跃的信息流也会像是你内在精神的一部分。

伊隆对巫师纪元的看法是,在巫师帽的众多用途中,它的核心功能之一会是作为你大脑和云端定制化 AI 系统的交互中介。他相信,这个 AI 系统会像本能和理性思维一样成为你人格的组成部分――并且和其他意识一样,感觉就像你的一部分。他说:

我认为,可以相信,会有一种方式使「数字的第三层」感觉起来就像是你的一部分。它不是用来临时代替你的,它就是你。

这在理论上是合理的。你用大脑皮层完成大部分「思考」,但当你饿了时,你不会说,「我的边缘系统饿了」,你说,「我饿了」。同样的,伊隆认为,当你尝试给一个难题想解决方案,且 AI 带着答案出现时,你不会说,「我的 AI 搞定这个问题了」,你会说,「啊哈!我搞定这个问题了」。当你的边缘系统想要拖延而皮层想要工作时,可能会有这样一个熟悉的场景,它不像是你在与某外部存在争论,它像是你自己在挣扎着要变自律一些。相似的,当你在工作上想出一个策略而你的AI不同意,这会产生意见不合且带来争论――但它会感觉像是一个内部争论,不是你和一个碰巧进入你思想的外人在争论。这个争论会感觉像是思考。

这在理论上是合理的。

但当我第一次听到伊隆谈起这个概念时,它给人感觉不太对。不论我多努力去理解它,我不停地用熟悉的概念去解释它――比如一个我能在脑中听到它声音的 AI 系统,或者甚至是一个我能与之一同思考的 AI。但在这些例子中,AI 似乎仍然作为一个外部系统与我交流。

再之后,有天晚上工作时,我在重读一些伊隆关于这个概念的言论,我突然领悟到,AI 应该成为我。彻底成为我。我懂了。

然后我又搞不懂了。第二天,我尝试把我的顿悟解释给一个朋友听,并成功把我俩一块儿搞糊涂了。我的理解又退回这样的状态,「等下,它好像不会真的成为我,它会和我进行交流」。自此之后,我就不断想通又搞混这个想法,再也没能持续把握住这个概念。与之最相似的情况是,有一段时间里,我觉得时间是相对的和时空是种单一结构还挺有道理的。有那么一瞬间,我直观地理解了当你移动得足够快时间会变慢。然后我就搞不懂了。在我敲下这些句子的现在,我还是不能直观理解这个概念。成为 AI 这个概念尤其不好理解,因为结合了两个令人困惑的概念――人脑交互与它带来的能力,以及人造通用智能。人类现在还不能直接理解这两个概念的任何一个,因为我们虽然极富想象力,但它却都是基于我们生活现实的,而这两个概念对我们来说都完全超现实了。这就像是尝试想象一种你从未见过的颜色一样。

这就是为什么当我听伊隆描述他的这些信念时,我会摇摆于坚信自己和被他说服的状态之间。反反复复。但既然他 7 岁就理解了相对论,且还知道如何殖民火星,我倾向于认真听他说。

他说带宽非常关键。要想使巫师帽起作用,带宽的作用非常重要。但伊隆相信,要实现与 AI 之间的交互,与单纯使用 AI 相比,高带宽不仅仅是成为 AI 的优先选项,实际上在初期它是先决条件。他是这样向我阐述他的想法的:

挑战在于与 AI 之间通信的带宽是很低效的,尤其在信息发送方面。当借助手机发送信息时,你只能用两个拇指慢慢打字。这简直慢得要命。……如果带宽太低,你和 AI 的结合就会非常弱。极低带宽带来的限制,会让这种结合变得有些没有意义。AI 会自行运行,因为与人的对话太慢了。通信的速度越快,你与 AI 的结合度就越高――通信的速度越慢,结合度就越低。我们与 AI 的结合越差――AI 越独立――它背叛我们的可能性就越高。如果 AI 完全独立,并且拥有远远高于我们的智能,你如何保证它们的最优化功能不会与人类的利益相背?……如果我们实现了与 AI 紧密共生,AI 就不会独立出来――它会成为你,并且与你大脑皮层的关系会类似于大脑皮层和边缘系统的关系。

伊隆看到了通信带宽决定了我们与 AI 的结合程度,也看到了结合程度决定了我们未来在 AI 世界中的位置:

我们将面临着一个选择,是被远远超过,或是不比宠物更有用――比如家猫之流,你懂的――又或是最终找出某种方法与 AI 结合后共生。

紧接着他又说:

另外,被当成家猫倒也是个好结果。

即便不知道超级 AI 时代来临时会出现什么样的 AI,与 AI 的结合能作为对我们种族的保护这一点也是很容易理解的。AI 纪元里我们的威胁来自坏人掌握了 AI 技术,或者发狂的 AI 不认同人类存在的价值。在数百万人都能各自控制世界 AI 整体的一小部分的世界里――包括可以与 AI 一同思考且保护自己的人们,和因为与 AI 的融合而能从根本上理解 AI 的人们――人类是没有那么脆弱的。人们会非常强大,这很恐怖,但正如埃隆所说,如果每个人都是超人,那么单个超人就很难造成大规模的破坏――有太多的阻碍和制衡存在。而且通常我们更不可能失去对 AI 的控制,因为地球上的 AI 在其目的上会非常多样和独立。

但时间在这里相当重要――伊隆着重强调了这一点:

在这个方向上的计划进程至关重要。我们不希望数字超级智能的开发比人脑 AI 的交互出现得早太多。

当我想到所有这些时,一个不确定之处是,一个全脑 AI 交互是否足以使人脑与 AI 的融合成为可能。我向伊隆提到了这点,指出当时人脑的思维速度与电脑之间仍然会有着巨大的差距。他说:

是的,但是提高带宽的量级能大大改善这个情况。而且它在解决问题的思路上对了。这个做法能解决所有的问题么?不能。但它的思路对么?对。如果你要挑些方向去解决这个问题,为什么不选这个方向呢?

这就是为什么伊隆要创立 Neuralink。

他创建 Neuralink 以加快我们进入巫师纪元的步伐――进入一个新世界,在这里,如他所说,「每个人都可能选择让 AI 成为其自身的拓展,所以会存在数十亿个『人类-AI』共生体,他们可以共同做出关于未来的决定。」在这个世界里,AI 真的可以变得「民有、民治、民享」。

读完之前几万字的文章,一部分的你相信我们居住的这个疯狂世界真会成为未来――另一部分则拒绝相信。我也同时有这两个想法。

其中疯狂的部分不应该成为难以相信它的理由。记住,乔治・华盛顿在他看到 2017 年的时候被吓死。而我们未来的颠覆性会是难以想象的。唯一的区别是,现在事物的变化要比乔治的时代快得多。

「被未来吓死」这个概念与我们集体智慧的魔力相关――但它也与我们直觉中的天真相关。我们思维的进化是在一个极其缓慢的过程中完成的,我们的身体是以适应这个过程为准的。而如果我们不积极地改造我们的直觉――我们自身中看到了未来的不可思议却拒绝相信的那部分――我们就是在骗自己。

事实是,我们正在朝一个非常严酷的目标狂奔在一条严酷的路上,没人知道目的地有什么在等着我们。很多人不敢想象未来会怎样,我觉得这很有趣。因为当我们这些人出生时,没有像正常人一样生在正常的世界里,而是生在一部惊悚小说中。有些人了解了这一点,并决定像伊隆一样,竭尽所能让电影能有个好结局――感谢上帝他们正在这么做。因为我更想做一个什么都不用干的观众,老实坐在椅子上,为好人们加油。

不管怎样,我认为一边爬树一边不时看看外面的风景是很好的,这能提醒我们自己正处在什么样的时代中。而且附近还有很多树。希望很快能在另一棵上见到你。

Tim Urban

知名科技博客Wait But Why的博主,他的长篇博文经常被媒体引用并报道, 他曾在Ted上做过一个有关拖延症的演讲。

翻译:塔娜、徐雪儿、王沫涵、任宁、何聪聪

校对:关嘉伟