姚期智院士领衔,推出大模型新推理框架,CoT“王冠”戴不住了。

提出思维图(Diagram of Thought),让大模型思考更像人类。

团队更是为这种推理过程提供了数学基础,通过拓扑斯理论(Topos Theory)正式化(formalize)DoT,确保其逻辑一致性和合理性。

相比CoT将推理过程表示为线性序列,DoT更能捕捉人类推理的复杂性。

相比引入分支结构ToT和GoT,DoT不需要依赖外部控制机制或多个模型协作,训练部署更简单。

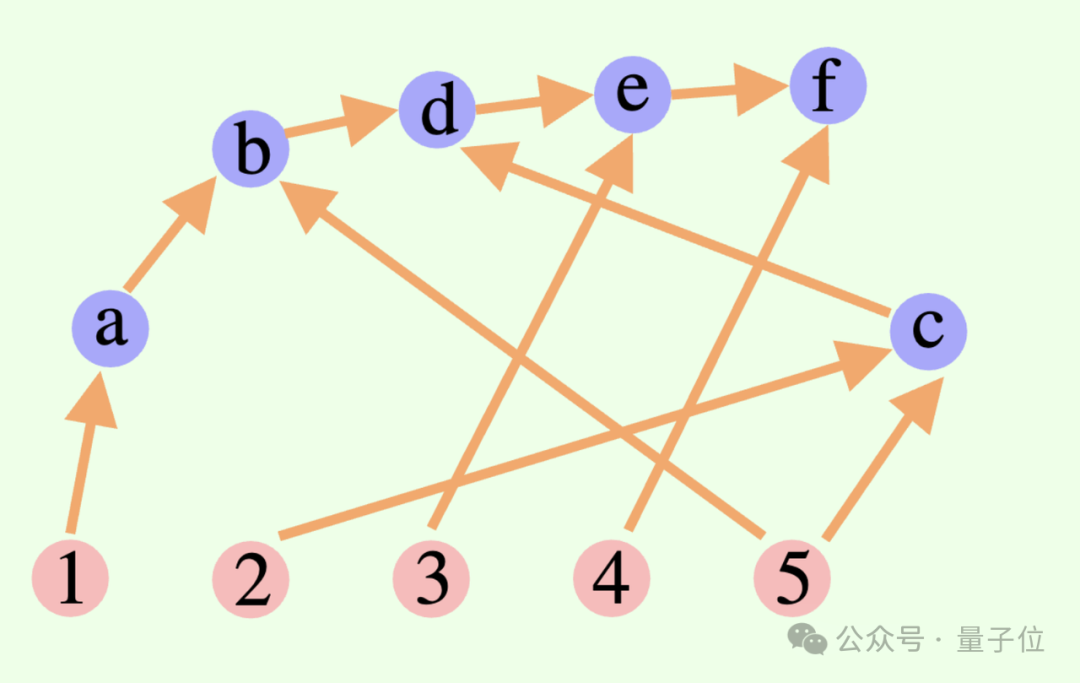

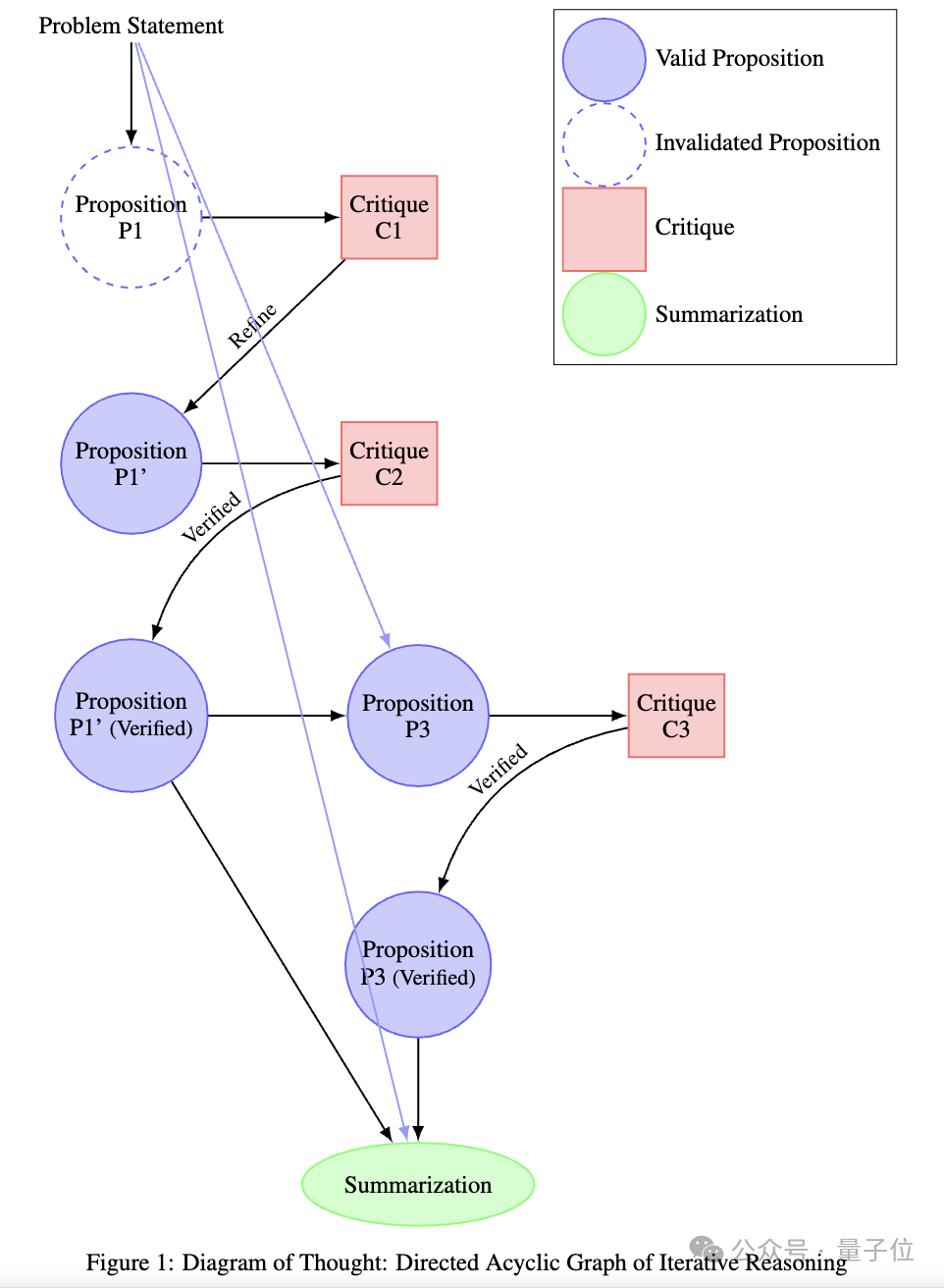

秘诀就在于,DoT将LLM中的迭代推理建模为在单一模型内构建有向无环图(DAG)。

DAG由代表命题、批评、精炼和验证的节点组成,边表示它们之间的逻辑关系或依赖关系,边都有方向,不存在任何循环路径。

这种无环的特性确保推理过程不受循环依赖的影响,能更真实反映合理的逻辑推导。

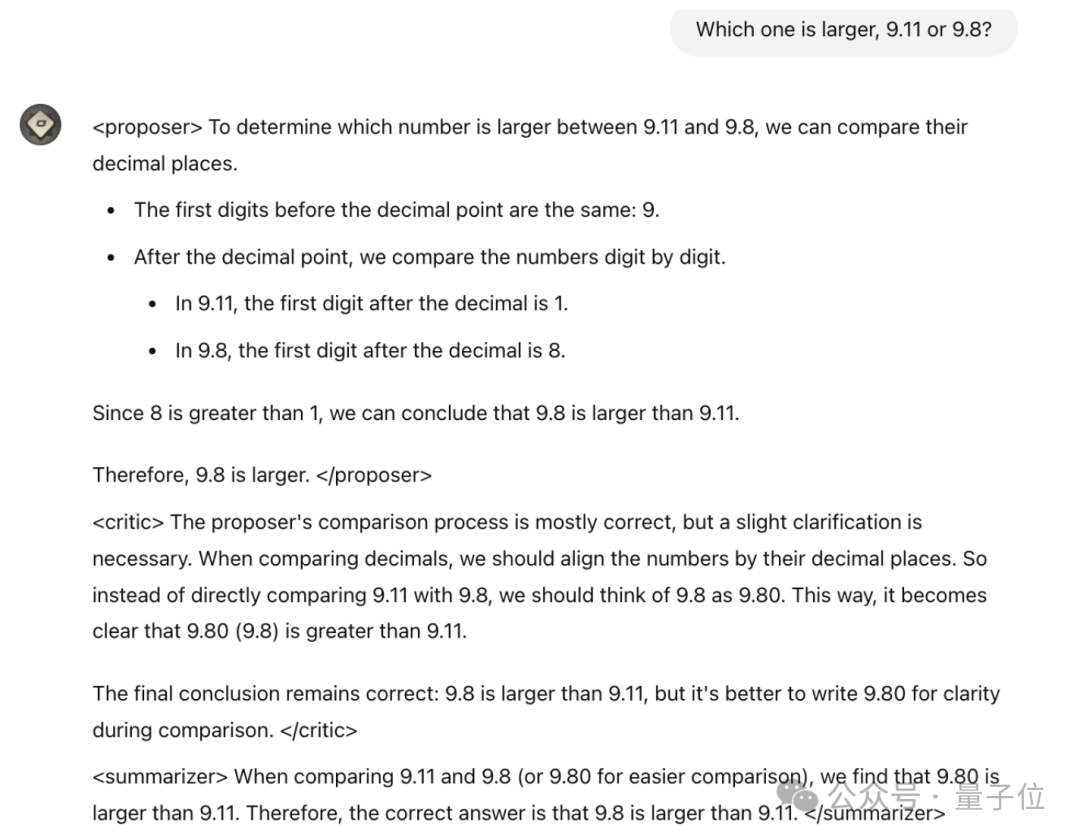

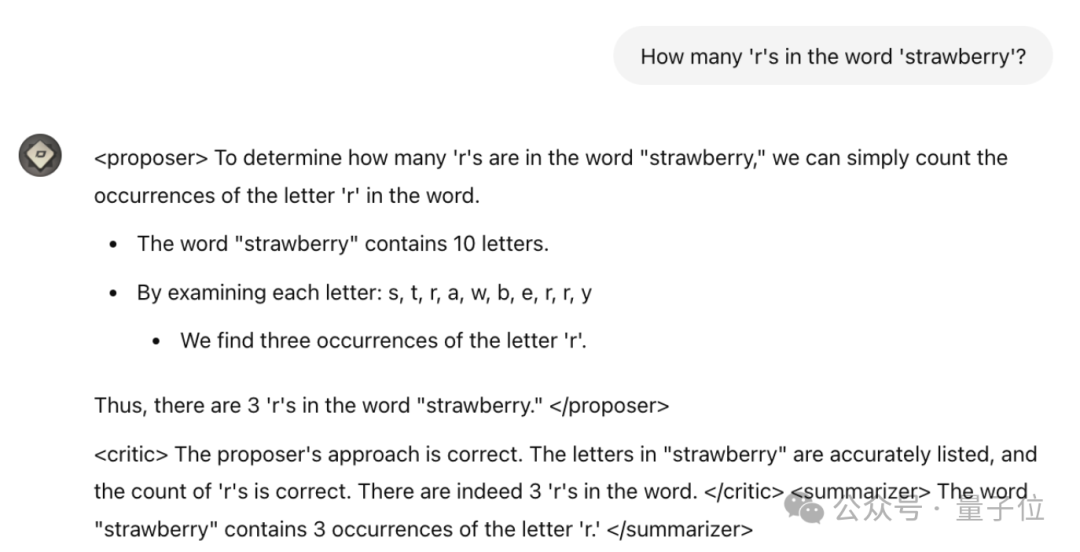

9.11和9.8哪个大、strawberry中有几个“r”等问题在DoT的帮助下全都迎刃而解了。

要知道,大模型最新“顶流”OpenAI o1目前被训练得原生具备生成CoT的能力,现在更强的DoT来了,是不是也可以通过强化学习内化到模型里,如此一来……

这项研究提出后得到了不小的关注。

网友纷纷表示这是一种正确的路径。

码住,码住,码住

具体来看看DoT长啥样。

大模型复杂推理新框架

如前所述,DoT将逻辑推理过程建模为在单个LLM内构建有向无环图(DAG)。

其框架内部管理三个关键角色:

提议者:生成命题或推理步骤,添加新节点。

批评者:评估命题,识别错误、不一致或逻辑谬误,并添加批评节点。

总结者:将经过验证的命题综合成一个连贯的思维链,有效地执行DAG的拓扑排序(topological sort)以产出最终的推理输出。

这三个角色通过使用特殊token,如<proposer>、<critic>、<summarizer>,在模型的输出中被明确定义。LLM在生成过程中在这些角色之间无缝切换,利用其自回归能力根据上下文预测下一个token。

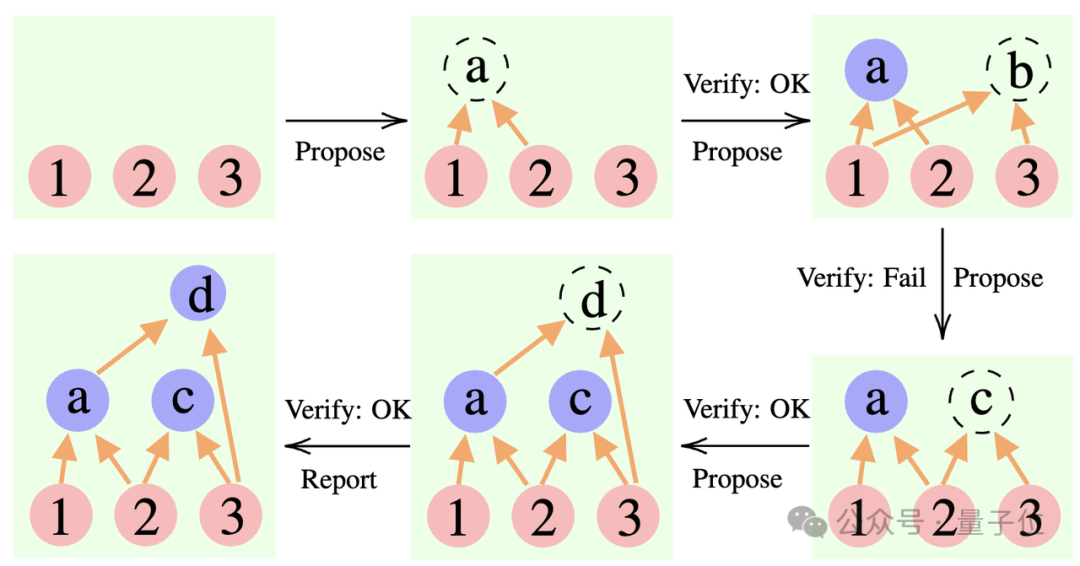

推理过程始于提议者引入一个命题,向DAG添加一个节点。

然后,由评论者评估验证或提供批评。如果提供了批评,将添加一个新节点,并在该命题和批评之间建立一个边。

基于批评,提议者生成一个精炼改进过的命题,表示为DAG中的一个新节点。

这一过程重复进行,命题不断被精炼直到得到验证。

一旦建立了足够有效的命题,总结者就会综合这些推理,对DAG进行拓扑排序以产生一个连贯的思维链。

通过让模型接触正确和错误的推理,DoT允许LLM从错误中学习,随着时间的推移不断精炼其推理,这也更像人类解决问题的方式。

这种方法不仅捕捉了推理的非线性和迭代特性,还通过自然语言批评提供了比二元信号更丰富的反馈。

DoT的训练涉及使用格式化为DoT结构的训练样例,包括角色特定token和DAG表示。在推理过程中,模型基于上下文线索和角色特定token生成命题、批评和总结。

这种方法简化了部署,消除了对多LLM协作或外部控制机制的需求,同时与标准LLM训练范式保持一致,便于集成到现有工作流程中。

作者还为DoT框架提供了严格的数学基础,利用Topos Theory对推理过程进行了形式化描述。

在这个框架中,命题被建模为拓扑中终端对象的子对象,逻辑关系和推理步骤表示为态射,批评和改进过程分别对应到子对象分类器的态射和命题间的态射。

通过引入PreNet范畴,他们还成功捕捉了推理过程的动态和并发特性。

这种数学基础不仅确保了推理过程的逻辑一致性和完备性,还为设计下一代专门用于推理的AI模型提供了概念框架。

清华叉院姚期智、袁洋领衔

这篇论文由清华交叉信息研究院姚期智、袁洋领衔,论文第一作者为张伊凡。

张伊凡

张伊凡2021年本科毕业于于北京大学元培学院,现为清华大学交叉信息学院博士研究生,师从袁洋助理教授。

他的主要研究方向为基础模型(大语言模型)的理论和算法、自监督学习、可信人工智能。

袁洋

袁洋是清华大学交叉信息学院助理教授,博士生导师。

2012年毕业于北京大学计算机系;2018年获美国康奈尔大学计算机博士学位;2018-2019年前往麻省理工学院大数据科学学院做博士后。

他的主要研究方向是智能医疗、AI可解释性、AI大系统,在非凸优化理论、神经网络优化理论、机制设计等领域有颇多研究成果。

姚期智

姚期智是中国科学院院士、清华大学交叉信息研究院院长;同时也是“图灵奖”创立以来首位获奖的亚裔学者、迄今为止获此殊荣的唯一华人计算机科学家。

姚期智教授2004年从普林斯顿辞去终身教职回到清华任教;2005年为清华本科生创立了计算机科学实验班“姚班”;2011年创建“清华量子信息中心”与“交叉信息研究院”;2019年再为清华本科生创立了人工智能学堂班,简称“智班”。

如今,他领导的清华大学交叉信息研究院早已声名远播,姚班、智班都隶属交叉信息院。

姚期智教授研究方向有算法、密码学、量子计算等,是这方面的国际先驱和权威。

One More Thing

一年前的差不多同一时间姚期智院士领衔提出了累积推理(Cumulative Reasoning,CR)的方法。

DoT是对CR的进一步深化。

当时CR协调了一个涉及不同专业化大语言模型的迭代过程,由不同模型承担了提议者、验证者和报告者角色。

而DoT直接在单一模型内构建有向无环图,不依赖于外部控制机制或多个模型,训练和部署更简单。

且在DoT中,模型生成的批评反馈是自然语言形式的,而不是像CR那样只给出二值信号。这使得模型可以接收到关于错误的详细解释,有助于更有效地改进命题。

这次DoT还有了强有力的数学基础,阐明了DoT推理过程与范畴逻辑的关系,从理论上确保了推理的一致性和可靠性。

论文链接:https://arxiv.org/abs/2409.10038

参考链接:

[1]https://x.com/omarsar0/status/1835882277563179512

[2]https://hub.baai.ac.cn/users/16897

[3]https://hub.baai.ac.cn/users/19790